Moderator: Redaktörer

.

.

(1)

(1)

(3)

(3)

DQ-20 skrev:DQ-20 skrev:Reserverat

Almen skrev:Nice. Kanske kan bli en artikel av det.

DQ-20 skrev:Reserverat

PerStromgren skrev:F5.F5.F5.F5.F5.F5.

_________________

... tycker jag!

Per

DQ-20 skrev:Jag är vare sig matematiker eller statistiker, dvs. jag har ingen grundexamen i statistik eller matematik, om någon undrar.

/DQ-20

Naqref skrev:Den här gör vi till sticky redan nu.

KarlXII skrev:DQ-20 skrev:Jag är vare sig matematiker eller statistiker, dvs. jag har ingen grundexamen i statistik eller matematik, om någon undrar.

/DQ-20

Vad är du då?

dimitri skrev:Nu är inte F/E tester livsavgörande.

dimitri skrev:statistik är område där det intuitiva kan krocka med det matematiska. Det är eller brukar vara eller naturligt att det intuitiva försvaras. Det har hänt mig här på Faktiskt. Med all respekt för statistik och matematik kommer människan alltid att reagera intuitivt i livsavgörande situationer. Nu är inte F/E tester livsavgörande. Gott så

Svante skrev:Jag känner mig konfident att detta kommer att bli en bra tråd.

Svante skrev:DQ-20 skrev:Reserverat

Voffödådå, det är väl bara att redigera förstainlägget?

aisopos skrev:Däremot denna (som jag inte själv är klar med än) verkar rejält gedigen med hur mycket

info som helst att ösa ur.

http://www.bbs.hik.se/utbildning/kurssi ... ns_bbs.pdf

roggaro skrev:EDIT: förresten vad har sannolikhetskalkyler med faktiskt att göra

DQ-20 skrev:1. STATISTISK INFERENS

Statistisk inferens handlar om att utifrån ett begränsad antal fall (URVAL) uttala sig om ett stort antal fall som vi av någon anledning anser utgöra en avgränsad grupp med gemensamma attribut (POPULATION). Populationer kan vara ÄNDLIGA och empiriska, som t.ex. alla barn födda i Sverige 2012. En sådan population skulle vi i princip kunna göra en totalundersökning på om vi bara hade tillräckligt fullständiga register. När det gäller experiment använder man sig av en annan typ av populationsbegrepp, nämligen en HYPOTETISK OÄNDLIG POPULATION, t.ex. alla utförda och ännu inte utförda f/e-lyssningar genomförda under samma förutsättningar. En HYPOTETISK OÄNDLIG POPULATION av försök (fall; händelser) är alltså det begrepp som ligger till grund för statistisk inferens från experiment. Kravet på att göra den hypotetiska populationen OÄNDLIG kommer sig av att vi måste säkerställa att populationen innehåller ALLA möjliga fall, även framtida, från vilka vi kan sägas dra ett slumpmässigt urval när vi utför våra experiment. Vi vill ju att våra slutsatser skall hålla även i framtiden. I en oändlig population har varje försök en oändligt liten sannolikt att komma med i urvalet, dvs. de försök som vi verkligen genomför. Dessutom antar man att alla försök har lika stor chans att komma med. En OÄNDLIG HYPOTETISK population kan också vara en lämplig modell för en till synes ÄNDLIG population, om man tänker sig att resultaten även skall gälla framtida versioner av populationen.

Överkurs:

Länken mellan URVALET och POPULATIONEN bygger på sannolikhetskalkyler. För att denna länk skall hålla måste vi kunna definiera sannolikheten för att ett visst försök eller fall ska komma med i urvalet. Alla fall måste INTE ha samma sannolikhet att inkluderas, men deras individuella sannolikheter måste vara KÄNDA. Detta kräver någon form av slumpmässig mekanism för att ta fram urvalet, men möjliggör också viktning av vissa typer av fall baserat på extern information om populationen. Om vi till exempel på FÖRHAND vet att en viss population består av 10% röda och 90% blå fall kan vi ÖVERSAMPLA de röda fallen så att vi får tillräckligt med röda fall (i ANTAL) i vårt urval. URVALET kommer alltså att ha en högre andel ”röda” än vad POPULATIONEN innehåller. ”Värdet” av dessa röda fall i urvalet måste vi dock ”skala ned” med inversen på vår översampling när vi gör inferenser till vår population.

Frågor på det?

Almen skrev:Nu är jag kanske fel ute, men vore det hemskt opassande att inkludera en lätt resonerande Bayes-analys av en F/E-lyssning? Som ett komplement, liksom.

DQ-20 skrev:KarlXII skrev:DQ-20 skrev:Jag är vare sig matematiker eller statistiker, dvs. jag har ingen grundexamen i statistik eller matematik, om någon undrar.

/DQ-20

Vad är du då?

Skit i det du, så lever du längre!

Naqref skrev:Jag tror du är ekonom. Det är bara de som är mentalt rustade för så menlösa och urtråkiga ämnen som ekonomi och statistik.

DQ-20 skrev:1. STATISTISK INFERENS

---

När det gäller experiment använder man sig av en annan typ av populationsbegrepp, nämligen en HYPOTETISK OÄNDLIG POPULATION, t.ex. alla utförda och ännu inte utförda f/e-lyssningar genomförda under samma förutsättningar. En HYPOTETISK OÄNDLIG POPULATION av försök (fall; händelser) är alltså det begrepp som ligger till grund för statistisk inferens från experiment.

---

Frågor på det?

DQ-20 skrev:Almen skrev:Nu är jag kanske fel ute, men vore det hemskt opassande att inkludera en lätt resonerande Bayes-analys av en F/E-lyssning? Som ett komplement, liksom.

Det kommer, hade jag tänkt, dels under sannolikhetsbegrepp, dels under tolkning av signifikanstest. Mest som en passus, men det är viktigt för att förstå att signfikansnivå inte säger något om hur sannolika parametrarna är, såvida man inte använder sig av en bayesiansk approach.

Almen skrev:DQ-20 skrev:1. STATISTISK INFERENS

---

När det gäller experiment använder man sig av en annan typ av populationsbegrepp, nämligen en HYPOTETISK OÄNDLIG POPULATION, t.ex. alla utförda och ännu inte utförda f/e-lyssningar genomförda under samma förutsättningar. En HYPOTETISK OÄNDLIG POPULATION av försök (fall; händelser) är alltså det begrepp som ligger till grund för statistisk inferens från experiment.

---

Frågor på det?

Ja, är detta alltså Fisher's exact test?

Almen skrev:DQ-20 skrev:Almen skrev:Nu är jag kanske fel ute, men vore det hemskt opassande att inkludera en lätt resonerande Bayes-analys av en F/E-lyssning? Som ett komplement, liksom.

Det kommer, hade jag tänkt, dels under sannolikhetsbegrepp, dels under tolkning av signifikanstest. Mest som en passus, men det är viktigt för att förstå att signfikansnivå inte säger något om hur sannolika parametrarna är, såvida man inte använder sig av en bayesiansk approach.

Utan att kunna något om Bayes så känns det, med utgångspunkt från de lyssningstester jag varit med och arrangerat, som att priorn uppskattas väldigt olika av de olika deltagarna. Kan du inkludera lite hur man resonerar där också?

Almen skrev:Jo, jag försöker sätta mig in lite i Bayes, känns lite som allmänbildning.

Ser fram emot kommande inlägg.

DQ-20 skrev:När man använder kombinatorik för att räkna ut chansen för svara rätt 7 gånger i rad i ett f/e-test trots att svaren är avgivna helt slumpmässigt, är det KLASSISKA definition av sannolikhet som dyker upp. Sannolikheten att i en helt slumpmässig process svara alla rätt ELLER alla fel 7 gånger i rad blir då (1+1)/7^2≈0,04.

Svante skrev:DQ-20 skrev:När man använder kombinatorik för att räkna ut chansen för svara rätt 7 gånger i rad i ett f/e-test trots att svaren är avgivna helt slumpmässigt, är det KLASSISKA definition av sannolikhet som dyker upp. Sannolikheten att i en helt slumpmässig process svara alla rätt ELLER alla fel 7 gånger i rad blir då (1+1)/7^2≈0,04.

Du menar (1+1)/2^7≈0,016.

DQ-20 skrev: (Jag noterade att din kommentar saknade frågetecken...)

Svante skrev:DQ-20 skrev: (Jag noterade att din kommentar saknade frågetecken...)

Ja?

DQ-20 skrev:Svante skrev:DQ-20 skrev: (Jag noterade att din kommentar saknade frågetecken...)

Ja?

KarlXII skrev:DQ-20 skrev:Svante skrev:DQ-20 skrev: (Jag noterade att din kommentar saknade frågetecken...)

Ja?

Lämna för jösse namn inte för många uträkningar i posterna.

Svante får inget gjort på jobbet då; han måste nämligen kontrollräkna allesammans.

2-ch skrev:Naqref skrev:Jag tror du är ekonom. Det är bara de som är mentalt rustade för så menlösa och urtråkiga ämnen som ekonomi och statistik.

Har inte ekonomer grundexamen i matematik nu heller.... var är världen på väg

DQ-20 skrev:Men jävlar vad bra företagsekonomer var på att räkna på den tiden. De producerade mängder av modeller som var lika matematiskt eleganta som de var praktiskt irrelevanta.

DQ-20 skrev:Svante skrev:DQ-20 skrev: (Jag noterade att din kommentar saknade frågetecken...)

Ja?

Almen skrev:Nu är jag kanske fel ute, men vore det hemskt opassande att inkludera en lätt resonerande Bayes-analys av en F/E-lyssning? Som ett komplement, liksom.

DQ-20 skrev:Almen skrev:Nu är jag kanske fel ute, men vore det hemskt opassande att inkludera en lätt resonerande Bayes-analys av en F/E-lyssning? Som ett komplement, liksom.

För att förstå hur bayesiansk inferens fungerar kan det kanske vara bra med ett praktiskt exempel som är lätt att relatera till. Wikipedia-länken handlar om en vardagsföreteelse, nämligen spamfilter (med "supervised learning" i maskininlärningstermer). Det var när jag själv studerade funktionen hos ett specifikt bayesianskt spamfilter (K9), som "poletten" verkligen trillade ned vad gäller betydelsen av prior, posterior och Bayes teorem. Analogierna med bayesiansk inferens är ganska enkla att se, även om sannolikheterna egentligen är vektorer i exemplet.

http://en.wikipedia.org/wiki/Bayesian_spam_filtering

/DQ-20

DQ-20 skrev:(om man skall vara petig 175/(1000-1) eftersom det är ett urval).

Svante skrev:DQ-20 skrev:(om man skall vara petig 175/(1000-1) eftersom det är ett urval).

Kan du utveckla detta? Jag skulle ju säga att bästa estimatet för sannolikheten för 2:a i är 175/1000 baserat på det man vet.

Är det inte den där -1:a från standardavvikelsen du tänker på?

KarlXII skrev:DQ-20 skrev:Jag är vare sig matematiker eller statistiker, dvs. jag har ingen grundexamen i statistik eller matematik, om någon undrar.

/DQ-20

Näe.

Almen skrev:Spontant associerar jag till en iterativ, numerisk metod. Ligger det något i det?

DQ-20 skrev:Almen skrev:Spontant associerar jag till en iterativ, numerisk metod. Ligger det något i det?

Nja, de orden du använder associerar nog de flesta matematiskt bevandrade till andra saker. Själv tänker jag t.ex. på Newton-Raphson.

/DQ-20,001

Almen skrev:DQ-20 skrev:Almen skrev:Spontant associerar jag till en iterativ, numerisk metod. Ligger det något i det?

Nja, de orden du använder associerar nog de flesta matematiskt bevandrade till andra saker. Själv tänker jag t.ex. på Newton-Raphson.

/DQ-20,001

Mjo, men just det att man itererar sig fram till bättre och bättre värden av formen fn+1 = modifierad(fn).

DQ-20 skrev:Den här typen av texter är för övrigt "snutna ur näsan", i alla fall inte för mig, så ta det försiktigt med F5 den kommande veckan.

2-ch skrev:En ovanlig kombination, humor och ekonomi i samma mening.

Almen skrev:DQ-20 skrev:Den här typen av texter är för övrigt "snutna ur näsan", i alla fall inte för mig, så ta det försiktigt med F5 den kommande veckan.

Jag undrar om det inte skall in en negation i utsagan ovan. För den logiska konsistensen, alltså.

DQ-20 skrev:Almen skrev:DQ-20 skrev:Den här typen av texter är för övrigt "snutna ur näsan", i alla fall inte för mig, så ta det försiktigt med F5 den kommande veckan.

Jag undrar om det inte skall in en negation i utsagan ovan. För den logiska konsistensen, alltså.

INTE!

/DQ-20,001

Almen skrev:~"snutna ur näsan", alltså.

IngOehman skrev:Vabuari åsyftade möjligen inte hur det låter att säga februari förkylt, utan

kan ha varit en skojig sammansättning av Vab (vård av barn) och februari.

Och med Vabuarisuger menar du förstås att du använder en sådan hära:

Suveränt initiativ med statistiktråden förresten - må den bringa klarhet till

många!

Vh, iö

Almen skrev:Men... Vart tog inlägget vägen?

petersteindl skrev:Då skall alltså del 4 och del 5 komma

sebatlh skrev:H0 och HA...

Så anledningen till att du (DQ-20) inte gillar ordet konfidens är att i fallet F/E så får vi enbart reda på att det sanna medelvärdet inte verkar vara 0,5.

Men HA kan vara både 1 eller 0,8?

Kan man inte sätta upp nollhypotesen att det sanna medelvärdet är 0,9 eller bättre säg?

Då skulle det krävas max 10 rätt av 14 för att förkasta teorin med p är mindre än 0,05. (om jag inte gjorde fel med kalkylatorn)

Då borde man ju kunna säga sig ha en viss konfidens i att en förstärkare inte färgar. Om man kallar H0 för gränsen för fägring alltså

Rajt?

DQ-20 skrev:sebatlh skrev:H0 och HA...

Så anledningen till att du (DQ-20) inte gillar ordet konfidens är att i fallet F/E så får vi enbart reda på att det sanna medelvärdet inte verkar vara 0,5.

Men HA kan vara både 1 eller 0,8?

Kan man inte sätta upp nollhypotesen att det sanna medelvärdet är 0,9 eller bättre säg?

Då skulle det krävas max 10 rätt av 14 för att förkasta teorin med p är mindre än 0,05. (om jag inte gjorde fel med kalkylatorn)

Då borde man ju kunna säga sig ha en viss konfidens i att en förstärkare inte färgar. Om man kallar H0 för gränsen för fägring alltså

Rajt?

Nope.

"Konfidens" har inte med saken att göra så länge som det anger något som ens är i närheten av att uttrycka förtroendet för HA i ett signifikanstest. Jag vill att det skall vara glasklart. Den relativa frekvensen som du anger bör istället tolkas som effektstorlek, eftersom det är det. I ditt resonemang alltså. Resonemanget innebär vidare att man tänker sig att den apparat som detekteras i 70% av alla fall är mindre färgande än en apparat som detekteras i 90% av alla fall. Detta har inget med signifikans att göra, men frågan har varit uppe tidigare på faktiskt.se och jag tror vi kom fram till att det är ogörbart, även om argumenten var lite olika (från "feltänkt från början till slut" till "omöjligt att genomföra empiriskt").

Vad gäller dina äventyr i binomialkalkylatorn så vet jag inte riktigt vad du vill undersöka. En låg sannolikhet för att svara "rätt" i ett f/e-test innebär ju att förstärkaren är svår att detektera. En hög sannolikhet innebär att förstärkaren är lätt att detektera. Var vill du lägga "snittet" (i termer av sannolikhet) och varför?

För övrigt måste man svara en serie med 63 av 64 rätt för att kunna förkasta hypotesen att sannolikheten att svara rätt i varje enskilt försök är högst 0,9 (på 1%-nivån.) Varför man nu vill göra det.

/DQ-20

2. Statistiskt SIGNIFIKANTA resultat är resultat som är ovanliga, givet vissa antaganden om PARAMETERARNA (populationsegenskaper). Osannolika resultat är värda att lägga märke till. Förenklat: SIGNIFIKANT är det samma som OVANLIGT.

sebatlh skrev:"En smula" försenat svar men…

Jag skrev otydligt så jag omformulerar mig.

A) Jag försökte utröna kopplingen mellan H0 och HA. Om man har en binär utfallsmängd så borde man väl ändå få att om H0 kan förkastas med en sannolikhet om 99% så borde samma resultat ge att HA förkastas med 1% sannolikhet. Tyckte jag då. Men nu när jag skriver det såhär så inser jag orimligheten.

Säg att vi har två alternativ antingen färgar förstärkaren inte, eller så färgar den klart hörbart. I det här fallet så färgar förstärkaren. Det vet vi, men inte de som testar.

"Vi" lyssnar och får 20/20. Så nu kan vi med stor statistisk säkerhet förkasta teorin att det är slumpen som styr våra svar.

Men om vi vänder på det hela, kommer vi någonsin kunna producera en serie som ser ut som slumpen, bara vi gör tillräckligt många försök? Nja, det ska mycket till. Förstärkaren hörs ju. Det är inte längre samma stokastiska process i bakgrunden.

Så H0 och HA är inte varandras spegelbilder ens med en binär utfallsmängd.

Alltså blir 1-p konstigt. Eller för att citera dig.2. Statistiskt SIGNIFIKANTA resultat är resultat som är ovanliga, givet vissa antaganden om PARAMETERARNA (populationsegenskaper). Osannolika resultat är värda att lägga märke till. Förenklat: SIGNIFIKANT är det samma som OVANLIGT.

Vad som är ovanligt för H0 är inte per automatik vanligt för HA.

19/20 är kanske jätteovanligt för HA samtidigt som det är ovanligt för H0.

Har jag tänkt rätt den här gången då?

B) Att sätta nollhypotesen till något annat än 0,5.

Jag tänkte fel med sannolikheterna. Jag vände på det hela och glömde bort att målet är att förkasta en teori. Då blev antalet lyssningar mer hanterbart

Har man många lyssningar så kan man ju kolla på antal rätt / antal lyssningar bara för att få ett mått på hur svårt något är att detektera…

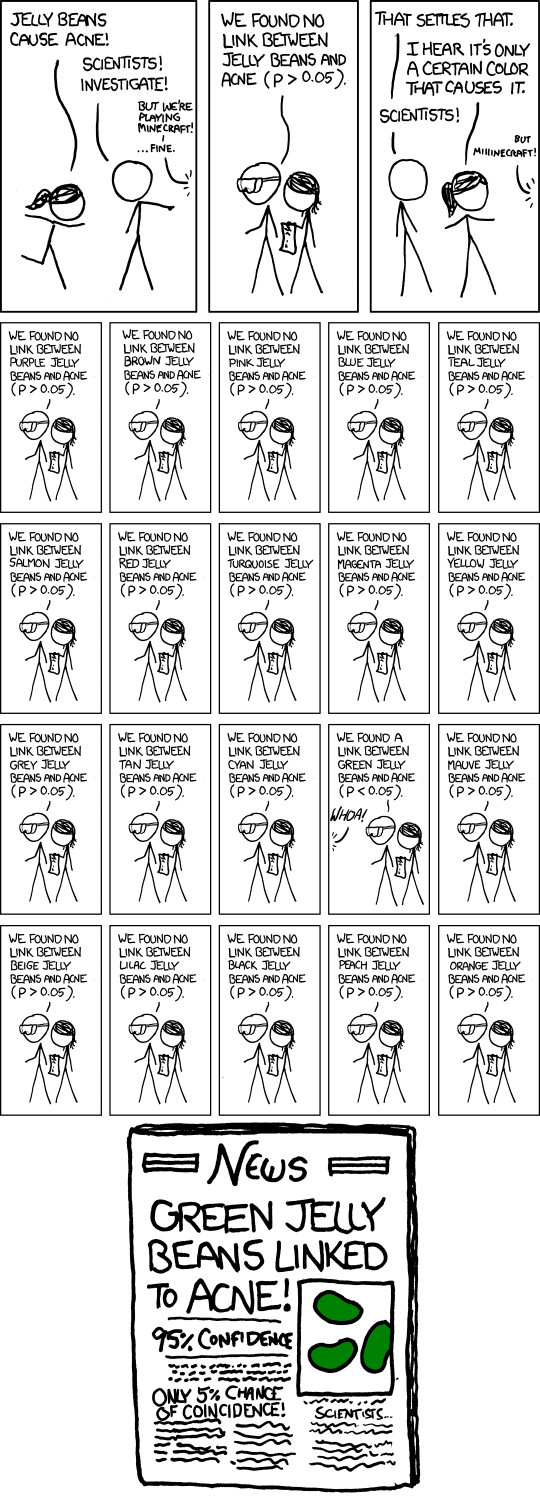

Morgan skrev:Ren komik för den som är hyggligt insatt i vad ett p-värde är.

grafpro skrev:Nu en konkret fråga som det alldeles säkert finns ett konkret svar på.

---

Möjligen är jag den siste i världen att inse att ett annat upplägg finns (jag såg det i ett nyhetsinslag om forskning på människors förmåga att känna skillnad på dofter): Lyssnaren får tre alternativ att välja på, där två i själva verket är detsamma. Frågan som ställs är "Vilken är annorlunda?".

grafpro skrev:Då har sakkunskapen sagt att om vi vill påstå att skillnad kunde höras med 99% säkerhet så kör man 9 lyssningar. Med 9 rätt är då saken klar.

grafpro skrev:Med färre rätt fortsätter man. 12 av 13 ger också 99%, liksom 14 av 16 eller 17 av 20.

grafpro skrev:Möjligen är jag den siste i världen att inse att ett annat upplägg finns (jag såg det i ett nyhetsinslag om forskning på människors förmåga att känna skillnad på dofter): Lyssnaren får tre alternativ att välja på, där två i själva verket är detsamma. Frågan som ställs är "Vilken är annorlunda?".

Slumpresutatet är därmed 1/3 i stället för 1/2 - hur ska då en testserie för 99% konfidens se ut?

DQ-20 skrev:grafpro skrev:Lyssnaren får tre alternativ att välja på, där två i själva verket är detsamma. Frågan som ställs är "Vilken är annorlunda?".

Slumpresutatet är därmed 1/3 i stället för 1/2 - hur ska då en testserie för 99% konfidens se ut?

Det där får jag nog fundera på.Men OM det är en sannolikhet på 1/3 att svara rätt är det väl bara att multiplicera på tills man når under 0.01, dvs.i det här fallet 5 gånger.

/DQ-20

IngOehman skrev:En klassiker, ja. Fast det var väl dörrar.

Vh, iö

IngOehman skrev:Fast skall man vara noga, och det skall vi väl här på faktiskt.se, så duger det inte att som du skrev

"ta bort ett av alternativen och fråga om man vill byta". Då ökar nämligen inte chansen av att byte

ett endaste någe.

Om målet var att peka ut den som är olika och testledaren däremot visar eller pekar ut ett av dem

som är lika efter att man valt, så förbättras oddsen om man byter till den andra. om det är ett slump-

spel vill säga. Den som hörde tydligt vilken som var annorlunda (och inte inbillade sig) förbättrar inte

några odds genom att byta i den situationen. Det måste vara ett slumpspel.

Vh, iö

grafpro skrev:Tråd ur spår. Tänka sig. Verkligen ingen som kan besvara frågan?

Almen skrev:grafpro skrev:Tråd ur spår. Tänka sig. Verkligen ingen som kan besvara frågan?

DQ-20 gjorde ett försök, men det såg du kanske inte: http://www.faktiskt.io/phpBB3/viewtopic.php?p=1657973#p1657973

Dessutom ställde jag en fråga till dig: http://www.faktiskt.io/phpBB3/viewtopic.php?p=1657113#p1657113

DQ-20 skrev:grafpro skrev:---

Slumpresutatet är därmed 1/3 i stället för 1/2 - hur ska då en testserie för 99% konfidens se ut?

...OM det är en sannolikhet på 1/3 att svara rätt är det väl bara att multiplicera på tills man når under 0.01, dvs.i det här fallet 5 gånger.

grafpro skrev:Almen skrev:grafpro skrev:Tråd ur spår. Tänka sig. Verkligen ingen som kan besvara frågan?

DQ-20 gjorde ett försök, men det såg du kanske inte: http://www.faktiskt.io/phpBB3/viewtopic.php?p=1657973#p1657973

Dessutom ställde jag en fråga till dig: http://www.faktiskt.io/phpBB3/viewtopic.php?p=1657113#p1657113

Ser faktiskt inget svar i något av dessa inlägg. Frågan löd:

För att nå 99% säkerhet i tester där testpersonen har två alternativ gäller först 9 lyssningar. Med 9 rätt är då saken klar. Med färre rätt fortsätter man. 12 rätt av 13 ger också 99%, liksom 14 rätt av 16 eller 17 rätt av 20.

Hur ser motsvarande serie ut i upplägg med tre alternativ?

Nu har jag inte sett just det programmet men triangle tests används en del när det gäller smaker så vitt jag förstår det.Almen skrev:grafpro skrev:Nu en konkret fråga som det alldeles säkert finns ett konkret svar på.

---

Möjligen är jag den siste i världen att inse att ett annat upplägg finns (jag såg det i ett nyhetsinslag om forskning på människors förmåga att känna skillnad på dofter): Lyssnaren får tre alternativ att välja på, där två i själva verket är detsamma. Frågan som ställs är "Vilken är annorlunda?".

Vad skulle förbättras i detektionsavseende menade man i programmet i fråga?

LasseA skrev:Nu har jag inte sett just det programmet men triangle tests används en del när det gäller smaker så vitt jag förstår det.Almen skrev:grafpro skrev:Nu en konkret fråga som det alldeles säkert finns ett konkret svar på.

---

Möjligen är jag den siste i världen att inse att ett annat upplägg finns (jag såg det i ett nyhetsinslag om forskning på människors förmåga att känna skillnad på dofter): Lyssnaren får tre alternativ att välja på, där två i själva verket är detsamma. Frågan som ställs är "Vilken är annorlunda?".

Vad skulle förbättras i detektionsavseende menade man i programmet i fråga?

http://en.wikipedia.org/wiki/Discrimina ... g#Triangle

Almen skrev:grafpro skrev:Nu en konkret fråga som det alldeles säkert finns ett konkret svar på.

---

Möjligen är jag den siste i världen att inse att ett annat upplägg finns (jag såg det i ett nyhetsinslag om forskning på människors förmåga att känna skillnad på dofter): Lyssnaren får tre alternativ att välja på, där två i själva verket är detsamma. Frågan som ställs är "Vilken är annorlunda?".

Vad skulle förbättras i detektionsavseende menade man i programmet i fråga?

grafpro skrev:Jämfört med AB eller FE eller ABX behöver man alltså bara köra fyra lyssningar istället för nio för att nå så långt.

grafpro skrev:Almen skrev:grafpro skrev:Nu en konkret fråga som det alldeles säkert finns ett konkret svar på.

---

Möjligen är jag den siste i världen att inse att ett annat upplägg finns (jag såg det i ett nyhetsinslag om forskning på människors förmåga att känna skillnad på dofter): Lyssnaren får tre alternativ att välja på, där två i själva verket är detsamma. Frågan som ställs är "Vilken är annorlunda?".

Vad skulle förbättras i detektionsavseende menade man i programmet i fråga?

Ingen aning. Det var var ett kort nyhetsinslag om näsans förmåga, inte ett program. Sådana aspekter var nog långt utanför inslagets ambitionsnivå.

Men nu har vi ändå två små framsteg. Artikeln på wikipedia ger två namn åt metoden - "triangle" eller "XXY". Gott så, men inget svar på frågan alls.

Därtill en beräkning av sannolikheten att få alla rätt i en serie. Så långt är det hyggligt enkelt att beräkna. (1/3)^4 ger 1/81, vilket är 0,0123456. Alltså 98,7654% sannolikhet att det inte skedde av en slump vid fyra rätt av fyra. (Fem rätt av fem ger 99,588% säkerhet, för den klentrogne.) Det är ju mycket trevligt. Jämfört med AB eller FE eller ABX behöver man alltså bara köra fyra lyssningar istället för nio för att nå så långt.

Om vi nöjer oss med den nivån, hur ser då den fortsatta serien ut? Alltså för den som har tre rätt av fyra och vill fortsätta, etc. Det är fortfarande själva frågan.

Svante skrev:Man kan därför jämföra 5 lyssningar enkelsidigt med trevalsmetoden med 8 lyssningar dubbelsidigt med tvåvalsmetoden, båda ger <1% felrisk.

Almen skrev:Svante skrev:Man kan därför jämföra 5 lyssningar enkelsidigt med trevalsmetoden med 8 lyssningar dubbelsidigt med tvåvalsmetoden, båda ger <1% felrisk.

Och eftersom varje lyssning i trevalsmetoden egentligen är (minst) tre, och varje lyssning i tvåvalsmetoden är (minst) två, så har man att ställa 5*3 emot 8*2, d.v.s. 15 jämfört med 16.

grafpro skrev:Tråd ur spår. Tänka sig. Verkligen ingen som kan besvara frågan?

grafpro skrev:Alltså 98,7654% sannolikhet att det inte skedde av en slump vid fyra rätt av fyra.

grafpro skrev:Om vi nöjer oss med den nivån, hur ser då den fortsatta serien ut? Alltså för den som har tre rätt av fyra och vill fortsätta, etc. Det är fortfarande själva frågan.

Svante skrev:(Dög det, DQ?)

DQ-20 skrev:... de punkter i serien där man kan stanna när man har nått ett tillräckligt högt p-värdet

Almen skrev:DQ-20 skrev:... de punkter i serien där man kan stanna när man har nått ett tillräckligt högt p-värdet

Tillräckligt högt?

Svante skrev:Almen skrev:DQ-20 skrev:... de punkter i serien där man kan stanna när man har nått ett tillräckligt högt p-värdet

Tillräckligt högt?

Han menar nog när konfidensen är tillräckligt hög...

DQ-20 skrev:Svante skrev:(Dög det, DQ?)

Ja. Du har härmed benäget tillstånd att fortsätta skriva i den här tråden.

Och det är precis som du säger. Vill man ha ett entydigt p-värde associerat med en viss serie måste man räkna ut stopp-villkor. I praktiken förslår jag att man gör som du gjort, nämligen bestämmer sig för hur lång den längsta serien får vara och räknar ut de punkter i serien där man kan stanna när man har nått ett tillräckligt lågt p-värde (dvs. tillräckligt hög statistisk signifikans), GIVET den maximala längden på serien. Det är alltså stopp-villkor man räknar ut, inte "fortsättningsvillkor".

/DQ-20

Almen skrev:Precis, det är ju lätt att tänka konfidens när man inte är så insatt.

DQ-20 skrev:Almen skrev:Precis, det är ju lätt att tänka konfidens när man inte är så insatt.

Du, den där smileyn, var inte den lite väl ironisk? Halvvägs mellan frontalangreppet <ingen smiley> och.

Men som sagt: jag bjuder.

/DQ-20

Svante skrev:Almen skrev:Svante skrev:Man kan därför jämföra 5 lyssningar enkelsidigt med trevalsmetoden med 8 lyssningar dubbelsidigt med tvåvalsmetoden, båda ger <1% felrisk.

Och eftersom varje lyssning i trevalsmetoden egentligen är (minst) tre, och varje lyssning i tvåvalsmetoden är (minst) två, så har man att ställa 5*3 emot 8*2, d.v.s. 15 jämfört med 16.

Ja, och att jämföra tre med varandra känns dessutom klurigare än att jämföra två med varandra. Mentalt blir det tre jämförelser, svårare att hålla reda på i huvudet vilken man lyssnar på, det borde ta minst dubbelt så lång tid att komma fram till ett vettigt svar.

Besläktat med trevalsidén är annars ABX-test. Jag gillar inte den heller.

Svante skrev:Almen skrev:Svante skrev:Man kan därför jämföra 5 lyssningar enkelsidigt med trevalsmetoden med 8 lyssningar dubbelsidigt med tvåvalsmetoden, båda ger <1% felrisk.

Och eftersom varje lyssning i trevalsmetoden egentligen är (minst) tre, och varje lyssning i tvåvalsmetoden är (minst) två, så har man att ställa 5*3 emot 8*2, d.v.s. 15 jämfört med 16.

Ja, och att jämföra tre med varandra känns dessutom klurigare än att jämföra två med varandra. Mentalt blir det tre jämförelser, svårare att hålla reda på i huvudet vilken man lyssnar på, det borde ta minst dubbelt så lång tid att komma fram till ett vettigt svar.

Besläktat med trevalsidén är annars ABX-test. Jag gillar inte den heller.

IngOehman skrev:Håller med om allt det där.

In i minsta detalj faktiskt.

- - -

Men - vad som är passande metod beror ju även på vad det är man undersöker, och därmed vilken frågan som

ställs och söks svar på är.

Om frågan är "är dessa samma?", så får man en sorts svar. Om den som får frågan svarar ja varje gång så är

det en indikation på att de låter rimligt lika, med just det använda programmaterialet, och samma sak gäller

om man i en triangellyssning inte lyckas säga vilken som skiljer sig, men det betyder inte ens nästan att det

som testats är två bra mojänger eller dimensioneringar eller vad det nu är man testar.

Det kan vara två som är dåliga, rejält dåliga till och med, men rätt så lika dåliga.

- - -

Om en är en referens för hur den andra skall vara (av något skäl, t ex att man vet att man redan gillar den)

är det frestande att studera kvaliteten genom att ställa "vilken gillar du bäst?", och även om svaret faller på

den ena varje gång så betyder det inte att det är den bättre återgivningen, det kan ju vara den som:

1. Passar bäst ihop med de kombinerade felen som resten av anläggning + inspelningen har,

vilket om inspelningen är perfekt kan betyda;

1b. Passar bäst ihop med de fel som resten av anläggningen har,

eller om anläggningen är perfekt;

1c. Passar bäst ihop med de fel som inspelningen har,

eller det kan rent av handla om vilken som,

2. Passar bäst ihop med lyssnarens smak, vilket även kan skrivas; den som subjektivt föredras.

Hur det än faller ut om det faller ut enligt någon av de ovanstående, så kan man inte veta om kan får sam-

ma utfall med annan inspelning eller med annat programmaterial. Ej heller om någon av apparaterna eller

vad det nu är som har undersökts, kanske hur något har dimensionerats, presterar i mera objektiva termer.

Alltså om det som kommer ut är ursprungstroget.

- - -

Där kommer F/E-lyssningen in!

Om frågan däremot (som den kan vara i en F/E-lyssning) är "vilket av alternativen är E?" så VET lyssnaren

att man jämför före och efter, och målet är bara att bestämma vilket man tror har passerat testobjektet.

Är färgningen från testobjektet rimligt hörbar (och man får öva lite) så är det vanligt att man kan pricka

in när signalen passerat testobjektet, varje gång. Färgningen påverkar ju signalen på samma sätt i princip

oavsett programmaterial. Det är en av styrkorna med F/E-lyssning: Varken programmaterial eller kringut-

rustning behöver det ställas extrema krav på (dock rimliga) för att man skall kunna undersöka testobjektets

egenskaper. Både bör vara rimligt bredbandiga och välbetedda, men hur de samverkar eller motverkar de

eventuella felen hos testobjektet är av ringa betydelse - skillnaden mellan E och F består.

Även om man gissar fel varje gång (kanske för att man föredrar E-ljudet) så visar det ändå skiljbarhet, och

då F alltid är referens så har en serie av idel felgissningar samma värde som en med idel rättgissningar. Båda

visar (med samma emfas) att apparaten färgar hörbart.

Så även om jag inte är en fan av varken ABX-tester eller triangeltester så är huvudskälet att de sällan gör

det man vill göra - om man vill undersöka ett färgande objekts absoluta egenskaper. Alltså få svar på HUR

det påverkar musiksignalen, snarare än hur man gillar denna påverkan i det ena eller andra sammanhanget.

Att de utöver det på statistiska grunder kan beskyllas för att inte spara något egentlig testansträngning är ju

möjligen generande för dem, men det är alltså inte mitt huvudskäl till att föredra en vanlig tvåvalssituation.

De andra testmetoderna fokuserar inte på att beskriva själva egenskaperna hos testobjektet, och det är ju

ofta det man (i varje fall jag) vill göra när jag studerar ett testobjekt.

Gissar man slumpmässigt rätt/fel mellan F och E i en F/E-lyssning så betyder det endera att man:

1. Inte klara att höra någon skillnad mellan F och E, vilket betyder att det färgar så lite att det blivit svårt

att höra dess påverkan.

eller att man,

2. Har för dåligt minne för att minnas hur testobjektet påverkadeHar man så dåligt minne så hjälper det

ju inte att man hör en skillnad för att veta vilken som troligen är E. Men då skall man kanske heller inte vara

lyssnare i en F/E-lyssning.

Dock är det faktiskt vanligare än man tror att själva blindheten påverkar lyssnarna så mycket att de, trots att

de lyssnat in sig öppet och vet hur testobjektet påverkar (och projicerar denna färgning som något negativt)

omvärderar färgningen för att de gillar den, och gissar konsekvent fel blindt!

Det gör som sagt inget, för det är ett konsekvent svarande som ger statistiskt växande skäl att tro att en skill-

nad (påverkan) finns.

Vh, iö

DQ-20 skrev:Tack för det inlägget IÖ. Det handlar ju om det som kallas metod, och det är så mycket mer än statistik. Man får inte bättre svar än data medger. Man kan dribbla hur mycket man vill med matematiken men om man inte har god validitet i metoden (mäter det man egentligen vill mäta) blir statistiken meningslös. Och det är här praktisk kunskap från det specifika området måste till - de räcker inte med generell kunskap om testmetoder, även om det ju inte är något hinder.

/DQ-20

Statistics Done Wrong is a guide to the most popular statistical errors and slip-ups committed by scientists every day, in the lab and in peer-reviewed journals. Many of the errors are prevalent in vast swathes of the published literature, casting doubt on the findings of thousands of papers. Statistics Done Wrong assumes no prior knowledge of statistics, so you can read it before your first statistics course or after thirty years of scientific practice.

Almen skrev:Statistics Done Wrong is a guide to the most popular statistical errors and slip-ups committed by scientists every day, in the lab and in peer-reviewed journals. Many of the errors are prevalent in vast swathes of the published literature, casting doubt on the findings of thousands of papers. Statistics Done Wrong assumes no prior knowledge of statistics, so you can read it before your first statistics course or after thirty years of scientific practice.

Han dristar sig alltså att i svepande ordalag klaga på forskares, naturvetenskapares och vetenskapliga publikationers kunskaper i statistik! perstromgren! Säg till honom på skarpen!

IngOehman skrev:Håller med, och menar att författaren tar upp ett viktigt ämne, och att medvetenheten om vilka ovetenskapliga tokigheter som förekommer i den akademiska världen (men ändå kallas vetenskap på grund av att akademisk och vetenskaplig ständigt landas ihop och/eller sätts likhetstecken mellan) verkligen behöver ökas.

Och jag tror dessutom att Almen skojade lite.

Om jag får ha en åsikt om vanligheten av fel i avhandlingar (av typen otillåtna slutsatser har dragits, ofta baserat på feltolkning av statisken) så är det att det handlar om så hög förekomst att det är sannolikare att man hittar en avhandling som har fel än en som saknar fel.

Men det sagt betyder det ju inte att en avhandling som har fel behöver ha fel i allt. Så är det förstås inte. Problemet är dock att den form som allmänhet, och i vissa fall även forskarkollegor, tar del av resultatet inte gör det möjligt att dra egna säkra slutsatser. För mycket information har gått förlorad från forskningen till det att det kom på papper, nästan alltid.

Vh, iö

Almen skrev:Jaa, grafpro, är du nöjd med svaren?

Jag hittade detta på nätet: http://www.statisticsdonewrong.com/

Har inte läst, bara skummat innehållsförteckningen, men det kanske kan vara intressant för de som frekventerar den här tråden?Statistics Done Wrong is a guide to the most popular statistical errors and slip-ups committed by scientists every day, in the lab and in peer-reviewed journals. Many of the errors are prevalent in vast swathes of the published literature, casting doubt on the findings of thousands of papers. Statistics Done Wrong assumes no prior knowledge of statistics, so you can read it before your first statistics course or after thirty years of scientific practice.

Han dristar sig alltså att i svepande ordalag klaga på forskares, naturvetenskapares och vetenskapliga publikationers kunskaper i statistik! perstromgren! Säg till honom på skarpen!

PerStromgren skrev:Han är doktorand. Sådana lyssnar inte!

Svante skrev:IngOehman skrev:Håller med, och menar att författaren tar upp ett viktigt ämne, och att medvetenheten om vilka ovetenskapliga tokigheter som förekommer i den akademiska världen (men ändå kallas vetenskap på grund av att akademisk och vetenskaplig ständigt landas ihop och/eller sätts likhetstecken mellan) verkligen behöver ökas.

Och jag tror dessutom att Almen skojade lite.

Om jag får ha en åsikt om vanligheten av fel i avhandlingar (av typen otillåtna slutsatser har dragits, ofta baserat på feltolkning av statisken) så är det att det handlar om så hög förekomst att det är sannolikare att man hittar en avhandling som har fel än en som saknar fel.

Men det sagt betyder det ju inte att en avhandling som har fel behöver ha fel i allt. Så är det förstås inte. Problemet är dock att den form som allmänhet, och i vissa fall även forskarkollegor, tar del av resultatet inte gör det möjligt att dra egna säkra slutsatser. För mycket information har gått förlorad från forskningen till det att det kom på papper, nästan alltid.

Vh, iö

Nej, just, halten sanning är långt högre i akademiska/vetenskapliga artiklar än i övriga typer av publikationer. Den ligger nog solklart i topp. Man ska också komma ihåg att möjligheten att bedöma sanningshalten är mycket högre i dessa artiklar eftersom det är kutym att redovisa hur slutsatserna man har dragit är underbyggda. Det kan också vara så att man väljer att publicera trots att man vet att data eller analys innehåller någon typ av fel, men att man ändå bedömer att det är värt att publicera eftersom det är svårt eller omöjligt att utföra studien felfritt.

IngOehman skrev:Halten av sanning i vetenskapliga artiklar är alltid 100 %, för är den inte det så är de ju inte vetenskapliga.

IngOehman skrev:Min poäng var att begreppen "akademisk" och "vetenskaplig" oftast blandas samman. Kanske är det i gemene mans ögon samma sak rent av, och reflexion över orden saknas därför? Jag får ibland det intrycket.

Det är olyckligt - både när det leder till att någon underförstår att något som står i en avhandling är vetenskapligt, och när någon märker att det som står inte stämmer och klandrar vetenskapen som princip.

IngOehman skrev:Det är svårt att diskutera när du vill urholka begreppen, och när du på det underförstår att det inte är själva innehållet utan auktoritetstro (där auktoriteten skall vara den akademiska världen) som är grunden för vad man skall lita på så känns det även rätt så meningslöst att diskutera saken. Men du får ha din syn på saken. Bara så du inte tror något annat.

Och jag hoppas du inte tar det jag skriver personligt, representant för den akademska världen som du är. Jag har inte kritiserat dig, bara nämnt att ytan (att en skrift kommer från den akademiska världen) inte är en garant för kvalitet på innehållet, det är själva innehållet som bestämmer kvaliteten på arbetet. Kort sagt - förstår man det inte på egna grunder så finns det inget skäl att tro något om kvaliteten på det. Auktoritetstro, majoritetstro och tumregler suger, i princip alltid.

Vh, iö

IngOehman skrev:Det är svårt att diskutera när du vill urholka begreppen, och när du på det underförstår att det inte är själva innehållet utan auktoritetstro (där auktoriteten skall vara den akademiska världen) som är grunden för vad man skall lita på så känns det även rätt så meningslöst att diskutera saken. Men du får ha din syn på saken. Bara så du inte tror något annat.

IngOehman skrev:Och jag hoppas du inte tar det jag skriver personligt, representant för den akademska världen som du är. Jag har inte kritiserat dig, bara nämnt att ytan (att en skrift kommer från den akademiska världen) inte är en garant för kvalitet på innehållet, det är själva innehållet som bestämmer kvaliteten på arbetet. Kort sagt - förstår man det inte på egna grunder så finns det inget skäl att tro något om kvaliteten på det. Auktoritetstro, majoritetstro och tumregler suger, i princip alltid.

grafpro skrev:IngOehman skrev:Det är svårt att diskutera när du vill urholka begreppen, och när du på det underförstår att det inte är själva innehållet utan auktoritetstro (där auktoriteten skall vara den akademiska världen) som är grunden för vad man skall lita på så känns det även rätt så meningslöst att diskutera saken. Men du får ha din syn på saken. Bara så du inte tror något annat.

Och jag hoppas du inte tar det jag skriver personligt, representant för den akademska världen som du är. Jag har inte kritiserat dig, bara nämnt att ytan (att en skrift kommer från den akademiska världen) inte är en garant för kvalitet på innehållet, det är själva innehållet som bestämmer kvaliteten på arbetet. Kort sagt - förstår man det inte på egna grunder så finns det inget skäl att tro något om kvaliteten på det. Auktoritetstro, majoritetstro och tumregler suger, i princip alltid.

Vh, iö

Svårt att förstå att båda dessa herrar är forskarutbildade. Grundläggande vetenskapsteoretisk terminologi borde väl ändå vara vedertagen av alla.

grafpro skrev:Svårt att förstå att båda dessa herrar är forskarutbildade. Grundläggande vetenskapsteoretisk terminologi borde väl ändå vara vedertagen av alla.

Almen skrev:1. "statistical power"

Hur kan man räkna ut det i fallet F/E-lyssning? Känns som att det beror på vilka lyssnare som är tillstädes, hur man uppskattar mängden och graden av färgning hos testobjektet, etc.. Snuddar detta vid en bayesiansk prior?

Almen skrev:2. "multiple comparisons"

Detta har möjligtvis snuddats vid i "Le grande fil", men here goes. Upprepade test ökar p-värdet eftersom ju fler test man gör, desto större sannolikhet att man får en slumpmässig träff. I F/E-fallet finns kanske fyra lyssnare, två lämnar fullständiga lyssningsserier (varav en t.ex. 11 av 11 och en 7 av 11), en slutar gissa efter fem, och den sista lämnar inga svar alls. Hur räknar man?

Och om man sedan tar ytterligare en lyssning med bara den lyssnare som hade 11 och 11, med samma resultat, räknas detta också som "upprepade test"? För mig känns det som att resultatet stärks...

I princip kan väl det specifika testet även ses som ett i en oändlig rad tester och då blir ju resultatet inte mycket att ha i det avseendet. Men teoretiskt sett, när börjar man från scratch?

IngOehman skrev:Svårast är väl att bestämma hur man skall se på resultatet när det testas runt hela världen...

Säg att någon effekt studeras och de som studerar den finner att effekten upplevs finnas som funktion av det som man tänkte sig utlöste effekten. Nio gånger av nio svaras det rätt på när den utlösande faktorn slumpmässigt har varit med eller inte.

De stoppar där. Och man kan räkna ut hur sannolikt det är att slumpen fick dem att gissa rätt. En statistiker får uppdraget att göra det.

Men dagen efter så får man veta att samma studie har gjort på 6 ytterligare platser runt jorden, och alla de andra så fick man slumpresultat. Den statistiker man frågar vet dock inte om detta. Problemet blir filosofiskt. Är det svar man får från statistiken riktigt?

Man kan även tänka sig att det går en vecka tills saken testas på olika platser runt jorden. Är de det som statistikern räknat fram sant fram till det att man får veta resultaten från de andra studierna?

Vh, iö

IngOehman skrev:---/snip/---

Vad är det för chans att vinna på ett lotteri med bara en vinstlott och 1 000 000 lotter?

Svar - antingen 100%, eller 0%.

Den som säger 1 på 1 000 000 säger inte att det inte är 100% eller 0%, utan bara att man inte vet förrän man kollat lotten.

IngOehman skrev:Om en himlakropp är på väg mot jorden och en forskare säger att det är 15% risk att den skall träffa jorden, medan en annan säger att risken är 50%, vem har rätt?

Svar - ingen. Antingen kommer den att träffa, eller också kommer den inte att träffa. Det är 100% eller 0%.

De som säger 10% respektive 50% slåss egentligen bara om en sak - hur bra (eller rättare sagt hur dåliga) data de har. Det handlar båda om vad data säger och om man kan lita på detta... Men själva händelsen, verkligheten, den är som den är. Antingen som träffar den, eller också träffar den inte.

IngOehman skrev:- - -

Vad är det för chans att vinna på ett lotteri med bara en vinstlott och 1 000 000 lotter?

Svar - antingen 100%, eller 0%.

Den som säger 1 på 1 000 000 säger inte att det inte är 100% eller 0%, utan bara att man inte vet förrän man kollat lotten.

- - -

Om en himlakropp är på väg mot jorden och en forskare säger att det är 15% risk att den skall träffa jorden, medan en annan säger att risken är 50%, vem har rätt?

Svar - ingen. Antingen kommer den att träffa, eller också kommer den inte att träffa. Det är 100% eller 0%.

De som säger 10% respektive 50% slåss egentligen bara om en sak - hur bra (eller rättare sagt hur dåliga) data de har. Det handlar båda om vad data säger och om man kan lita på detta... Men själva händelsen, verkligheten, den är som den är. Antingen som träffar den, eller också träffar den inte.

DQ-20 skrev:IngOehman skrev:Svårast är väl att bestämma hur man skall se på resultatet när det testas runt hela världen...

Säg att någon effekt studeras och de som studerar den finner att effekten upplevs finnas som funktion av det som man tänkte sig utlöste effekten. Nio gånger av nio svaras det rätt på när den utlösande faktorn slumpmässigt har varit med eller inte.

De stoppar där. Och man kan räkna ut hur sannolikt det är att slumpen fick dem att gissa rätt. En statistiker får uppdraget att göra det.

Men dagen efter så får man veta att samma studie har gjort på 6 ytterligare platser runt jorden, och alla de andra så fick man slumpresultat. Den statistiker man frågar vet dock inte om detta. Problemet blir filosofiskt. Är det svar man får från statistiken riktigt?

Man kan även tänka sig att det går en vecka tills saken testas på olika platser runt jorden. Är de det som statistikern räknat fram sant fram till det att man får veta resultaten från de andra studierna?

Vh, iö

Det du tar upp är ju sk. meta-analys. Sådant brukar forskare göra när de på ett systematiskt sätt försöker bilda sig en uppfattning om kunskapsläget i ett forskningsfält. Det är normalt sett inget som "äkta" statistiker vill ta i med tång* av den enkla anledning att det inte går att ta fram några vettiga antaganden om fördelningar. Ingen fördelning - ingen statistik. Men man får försöka så gott man kan med de verktyg som står till buds och det kan innefatta både statistiska "resonemang" och bedömingar. Men man måste ha klart för sig att signifikansnivåer inte är ett bevis för någonting. Det är bara en indikation om att något statistiskt ovanligt har skett givet vissa antaganden. Om det är slumpen eller en verklig effekt kan vi aldrig veta med visshet i det enskilda fallet.IngOehman skrev:---/snip/---

Vad är det för chans att vinna på ett lotteri med bara en vinstlott och 1 000 000 lotter?

Svar - antingen 100%, eller 0%.

Den som säger 1 på 1 000 000 säger inte att det inte är 100% eller 0%, utan bara att man inte vet förrän man kollat lotten.

Jag förstår vad du menar men jag skulle inte uttrycka det som "chans" eftersom "chans" är den positiva varianten av "risk", dvs. ett sannolikhetsmått. Att efter försöket ange utfallet som 100% och 0% innebär att procentsatserna byter "filosofisk" status och är inte längre mått på sannolikhet. Det blir mest ett sätt att ange utfallsrummet vinst/inte vinst. Efter man har dragit har man ju visshet i det enskilda fallet och då är inte sannolikhet längre särskilt relevant. Sannolikhet, tolkat som relativ frekvens, är ju något som gäller för en oändlig mängd upprepade försök. Även med en klassisk definition av sannolikhet (antalet "fördelaktiga" utfall/antalet möjliga utfall) blir värdet detsamma: en på miljonen.IngOehman skrev:Om en himlakropp är på väg mot jorden och en forskare säger att det är 15% risk att den skall träffa jorden, medan en annan säger att risken är 50%, vem har rätt?

Svar - ingen. Antingen kommer den att träffa, eller också kommer den inte att träffa. Det är 100% eller 0%.

De som säger 10% respektive 50% slåss egentligen bara om en sak - hur bra (eller rättare sagt hur dåliga) data de har. Det handlar båda om vad data säger och om man kan lita på detta... Men själva händelsen, verkligheten, den är som den är. Antingen som träffar den, eller också träffar den inte.

Jag har ju gått igenom detta tidigare i tråden vad sannolikhet ("risk";"chans") innebär och här är det lätt att blanda ihop sannolikhetsbegreppen. En statistiker av normalsnitt avser relativ frekvens dvs. limes för andelen när antalet försök går mot oändligheten. Om den statistiskt lagde astrofysikern säger "15%" så avses "i 15% av alla fall som är identiskt med detta kommer himlakroppen att träffa jorden". Nu är det inte det svaret vi är ute efter utan en subjektiv sannolikhet för chansen att något inträffar i just det här fallet. Men se det får vi inte, för relativ frekvens är en egenskap hos fördelningen och är inte tillämpbar i det enskilda fallet. Sedan kan man spekulera i varför man har så pass "dålig" mätprecision för ett fysikaliskt förlopp där Newton räcker ganska långt, men det är kanske en annan fråga som leder från ämnet statistik.

/DQ-20

*) En hel del statistiker vill helst inte ta i empiriska data med tång överhuvudtaget utan föredrar simulerade data med kända statistiska egenskaper.

IngOehman skrev:Min poäng handlar om att man ofta talar om sannolikheter, även efter att ett val är gjort, och man kan argumentera både för att göra det, och mot att göra det.

Låt oss ta fallet med lotten - om man frågar vilken sannolikheten att vinna genom att ta den enda vinstlotten är, om man tar en slumpmässig lott av 1 000 000 lotter, så är det ju 1:1000 000, alltså 0,0001%.

Men vilken är sannolikheten om man redan valt lott?

Då är sannolikheten 100% eller 0%. Inget annat. Man vet fortfarande inte svaret, men det som 0,0001% är applicerbart är inte längre lotten, den är ju vad den är, utan 0,0001% gäller nu bara vad vi vet om den.

Vad är det för chans att vinna på ett lotteri med bara en vinstlott och 1 000 000 lotter?

Svar - antingen 100%, eller 0%.

Svante skrev:Det där förstod jag inte. Menar du att sannolikheten att man får en vinstlott, betingat att man redan har fått en vinstlott, inte är 1?

Svante skrev:...fast ligger inte detta limes redan i sannolikhetsbegreppet? Jag menar om jag säger at p=0,9, alltså inte "ungefär lika med", så har jag ju redan gjort gränsvärdesberäkningen med oändligt många utfall. Och då blir det bara tal man räknar med och P(B|A)=P(A∩B)/P(A)=1 eftersom P(A∩B)=P(A). Det skumma som du syftar på finns nog redan i sannolikhetsbegreppet, inte i räknandet med sannolikheterna (som ju är tal)?

Hmm.

DQ-20 skrev:Men återigen - sannolikheter är något som är en "repeated sampling property" (dvs. gäller en fördelning av händelser) när det gäller objektiv sannolikhet (klassisk; relativ frekvens) och gäller inte enskilda fall. Så jag TYCKER inte man skall tillämpa dessa sannolikhetsbegrepp i enskilda fall.

DQ-20 skrev:Om man tittar på Bayes teorem så blir det pannkaka när man sätter en P[prior]=0. Då blir även P[posterior]=0 oavsett data. Praktisk tolkning: oavsett vad du har för empiriska bevis tror jag ändå inte på det. Jag brukar använda det som argument att för att det är ovetenskapligt att säga att något är omöjligt (i meningen "never"). Därför: jag kan mycket väl ha fel med tanke på att jag är amatör och statistisk känslomänniska.

/DQ-20 km från F/E

IngOehman skrev:En SPECIFIK himlakropp kommer endera att kollidera med jorden, eller också gör den det inte.

Tage Danielsson skrev:Sannolikt va, det betyder väl nåt som är likt sanning. Men riktigt lika sant som sanning är det inte om det är sannolikt.

Nu har vi tydligen inte råd med äkta sanningar längre, utan vi får nöja oss med sannolikhetskalkyler. Det är synd det, för dom håller lägre kvalitet än sanningar. Dom är inte lika pålitliga. Dom blir till exempel väldigt olika före och efter.

Jag menar före Harrisburg så var det ju ytterst osannolikt att det som hände i Harrisburg skulle hända, men så fort det hade hänt rakade ju sannolikheten upp till inte mindre än 100 procent så det var nästan sant att det hade hänt.

Men bara nästan sant. Det är det som är så konstigt. Det är som om man menar att det som hände i Harrisburg var så otroligt osannolikt så egentligen har det nog inte hänt.

[...]

Och man förstår ju att [ett namngivet parti] har tvekat, för en sån olycka inträffar ju enligt alla sannorlikhetsberäkningar bara en gång på flera tusen år, och då är det ju i varje fall inte troligt att den har hänt redan nu, utan det är väl i så fall mera sannolikt att den har inträffat längre fram. Och då kommer ju saken i ett annat läge. För det kan ju inte vi bedöma nu. Då. Eller...

Sen är det också det att om det som hände i Harrisburg verkligen hände, mot förmodan, så är ju sannolikheten för att det ska hända en gång till, den är ju så oerhört löjligt jätteliten så att på sätt och vis kan man säga att det var nästan bra att det som hände i Harrisburg hände, om det nu gjorde det. För jag menar då kan man ju nästan säkert säja att det inte kommer hända igen.

I varje fall inte i Harrisburg. Och säkert inte samtidigt som förra gången.

Risken för en upprepning är så liten att den är försumbar. Med det manas att den finns inte, fast bara lite.

Nu är ju det här rätt krångligt för gemene man, så egentligen är det väl ingen idé att ha folkomröstning om sånt här. Folk i allmänhet dom tänker förstås på sitt grovhuggna vis att det som hände i Harrisburg verkligen har hänt. Dom tar det som en sanning. Tala alltid sanning, barn, sa våra föräldrar till oss. Det får vi inte säga till våra barn utan vi måste lära dom att alltid tala sannolikt. Att säga sannolikheten, hela sannolikheten och ingenting annat än sannolikheten.

Så att dom inser att det som hände i Harrisburg inte kan hända här, eftersom det inte ens hände där, vilket hade varit mycket mer sannolikt, med tanke på att det var där det hände.

IngOehman skrev:Okej, så då har du äntligen fattat och håller med?

PerStromgren skrev:Tage Danielsson skrev:Sannolikt va, det betyder väl nåt som är likt sanning. Men riktigt lika sant som sanning är det inte om det är sannolikt.

IngOehman skrev:Isåfall är det svårt att förstå vissa av dina tidigare inlägg eftersom de ser ut att se på saken på ett helt annat sätt.

IngOehman skrev:Men "man kan ju se"-perspektivet är inte vetenskapligt. Men visst kan man det. Om man vill ha en "indikation". Det enda vetenskapliga man kan ha den till är att hypotetisera vidare från, kanske för att få inspiration till vad man vill undersöka på riktigt? Istället lade man ned alla Concorde-flyglinjer.

Wikipedia skrev:Retirement

On 10 April 2003, Air France and British Airways simultaneously announced that they would retire Concorde later that year. They cited low passenger numbers following the 25 July 2000 crash, the slump in air travel following the September 11, 2001 attacks, and rising maintenance costs. Although Concorde was technologically advanced when introduced in the 1970s, 30 years later, its analogue cockpit was dated. There had been little commercial pressure to upgrade Concorde due to a lack of competing aircraft, unlike other airliners of the same era such as the Boeing 747. By its retirement, it was the last aircraft in British Airways' fleet that had a flight engineer; other aircraft, such as the modernised 747-400, had eliminated the role.

Svante skrev:IngOehman skrev:Men "man kan ju se"-perspektivet är inte vetenskapligt. Men visst kan man det. Om man vill ha en "indikation". Det enda vetenskapliga man kan ha den till är att hypotetisera vidare från, kanske för att få inspiration till vad man vill undersöka på riktigt? Istället lade man ned alla Concorde-flyglinjer.

Man-kan-se-perspektivet är i högsta grad vetenskapligt, vad som är ovetenskapligt är att inte ha koll på felkällorna och hur stora de är och därför dra felaktiga slutsatser.

Svante skrev:Det finns absolut fall där historien med god noggrannhet kan förutsäga framtiden, det handlar bara om att skaffa sig ett tillräckligt representativt urval, tillräckligt för det syfte man gör studien.

Svante skrev:Sen tror jag att alla inte är överens med dig om historieskrivningen kring Concorde. Var det inte så att linjen gick med förlust, och att det blev tämligen omöjligt att fortsätta med den efter att ett plan hade försvunnit?

Nattlorden skrev:Fanns ju andra problem för Concorde också... de blev av vissa nationer inte godkända för överljudsfart, så en del teoretiskt intressanta linjer att trafikera blev omöjliga, eller i alla fall menlösa...

IngOehman skrev:Nattlorden skrev:Fanns ju andra problem för Concorde också... de blev av vissa nationer inte godkända för överljudsfart, så en del teoretiskt intressanta linjer att trafikera blev omöjliga, eller i alla fall menlösa...

Min gissning är att de idag hade haft en bättre marknad än de hade när de lades ned.

Men oavsett vilket så tycker jag det är tråkigt att vi backar istället för att gå framåt.

Tiden då vi landade på månen och flög Concorde gav mig hopp för mänskligheten.

Vad sysslar vi med idag som kan mäta sig?

IngOehman skrev:..."man kan se" dina inlägg Svante, där du ständigt vill ha rätt mot iö och aldrig säger att du haft fel ens när du ändrar uppfattning, som ett tecken på att du har dålig självkänsla.

Bill50x skrev: De största vinsterna tidsmässigt gör vi nog med att förkorta restiderna till och från flygplatserna och minska tiden från det att du anländer till flygplatsen tills planet lyfter. Omvänt samma sak när du landat.

IngOehman skrev:Nattlorden skrev:Fanns ju andra problem för Concorde också... de blev av vissa nationer inte godkända för överljudsfart, så en del teoretiskt intressanta linjer att trafikera blev omöjliga, eller i alla fall menlösa...

Min gissning är att de idag hade haft en bättre marknad än de hade när de lades ned.

Men oavsett vilket så tycker jag det är tråkigt att vi backar istället för att gå framåt.

Tiden då vi landade på månen och flög Concorde gav mig hopp för mänskligheten.

Vad sysslar vi med idag som kan mäta sig?

IngOehman skrev:Svante skrev:Det finns absolut fall där historien med god noggrannhet kan förutsäga framtiden, det handlar bara om att skaffa sig ett tillräckligt representativt urval, tillräckligt för det syfte man gör studien.

Ja just det, och det är sådana man vill ha, inte ett beslut som tas efter EN incidens efter många, många år.

Svante skrev:Men säg att man bara har en olycka. Säg att vi hade lyckats göra fusionskraft och lyckats köra den i femtio år med en enda olycka.

Ska man helt ignorera kunskapen det kan ge eller ska man kanske försöka räkna ut ett väntevärde för felfrekvensen, med konfidensintervall, och sedan fatta beslut baserat på detta? Så fort man får konfidensintervallet (som kommer att bli stort) kommer man ju att kunna värdera data mycket bättre än om man tar ett panikbeslut direkt efter olyckan.

Nattlorden skrev:Svante skrev:Men säg att man bara har en olycka. Säg att vi hade lyckats göra fusionskraft och lyckats köra den i femtio år med en enda olycka.

Ska man helt ignorera kunskapen det kan ge eller ska man kanske försöka räkna ut ett väntevärde för felfrekvensen, med konfidensintervall, och sedan fatta beslut baserat på detta? Så fort man får konfidensintervallet (som kommer att bli stort) kommer man ju att kunna värdera data mycket bättre än om man tar ett panikbeslut direkt efter olyckan.

Antag att vi bara byggt en reaktor (och felet egentligem var något väldigt osannolikt). Vad säger statistiken då om man inte låter folk som förstår hur stort urval man behöver innan man kan dra slutsatser ur materialet med någon form av säkerhet?

Nattlorden skrev:IngOehman skrev:Nattlorden skrev:Fanns ju andra problem för Concorde också... de blev av vissa nationer inte godkända för överljudsfart, så en del teoretiskt intressanta linjer att trafikera blev omöjliga, eller i alla fall menlösa...

Min gissning är att de idag hade haft en bättre marknad än de hade när de lades ned.

Men oavsett vilket så tycker jag det är tråkigt att vi backar istället för att gå framåt.

Tiden då vi landade på månen och flög Concorde gav mig hopp för mänskligheten.

Vad sysslar vi med idag som kan mäta sig?

Nja, jag tror det blir svårt att få godkänt att släpa en ljudbangskon över befolkat område idag också... Så det blir omvägar över hav om man skall flyga fort... Eller fisflyga den delen som är över land...

Tja... Att SpaceX försöker återlanda sin bärraket tycker jag nog är rätt så häftigt.

Svante skrev:IngOehman skrev:..."man kan se" dina inlägg Svante, där du ständigt vill ha rätt mot iö och aldrig säger att du haft fel ens när du ändrar uppfattning, som ett tecken på att du har dålig självkänsla.

Är det så du ser det?

Svante skrev:Nattlorden skrev:Svante skrev:Men säg att man bara har en olycka. Säg att vi hade lyckats göra fusionskraft och lyckats köra den i femtio år med en enda olycka.

Ska man helt ignorera kunskapen det kan ge eller ska man kanske försöka räkna ut ett väntevärde för felfrekvensen, med konfidensintervall, och sedan fatta beslut baserat på detta? Så fort man får konfidensintervallet (som kommer att bli stort) kommer man ju att kunna värdera data mycket bättre än om man tar ett panikbeslut direkt efter olyckan.

Antag att vi bara byggt en reaktor (och felet egentligem var något väldigt osannolikt). Vad säger statistiken då om man inte låter folk som förstår hur stort urval man behöver innan man kan dra slutsatser ur materialet med någon form av säkerhet?

Nu ska vi se om jag förstår den sista meningen; Statistiken säger det den säger oavsett vem som drar slutsatser av den. Men det var nog inte det du menade. Menar du att det är lätt att dra fel slutsatser? Så är det nog. Min poäng är att även ett konfidensintervall behöver tas fram, och om man bara förstår vad ett konfidensintervall är och om man ser hur stort det blir så är det lättare att dra rimliga slutsatser. Alltså; problemet är inte att man drar slutsatser av en begränsad mängd data, problemet är att man drar fel slutsatser och framför allt inte tillåter sig se hur lite information som ligger i ett få-olycke-underlag.

Nattlorden skrev:Svante skrev:Men säg att man bara har en olycka. Säg att vi hade lyckats göra fusionskraft och lyckats köra den i femtio år med en enda olycka.

Ska man helt ignorera kunskapen det kan ge eller ska man kanske försöka räkna ut ett väntevärde för felfrekvensen, med konfidensintervall, och sedan fatta beslut baserat på detta? Så fort man får konfidensintervallet (som kommer att bli stort) kommer man ju att kunna värdera data mycket bättre än om man tar ett panikbeslut direkt efter olyckan.

Antag att vi bara byggt en reaktor (och felet egentligem var något väldigt osannolikt). Vad säger statistiken då om man inte låter folk som förstår hur stort urval man behöver innan man kan dra slutsatser ur materialet med någon form av säkerhet?

IngOehman skrev:Nattlorden skrev:Svante skrev:Men säg att man bara har en olycka. Säg att vi hade lyckats göra fusionskraft och lyckats köra den i femtio år med en enda olycka.

Ska man helt ignorera kunskapen det kan ge eller ska man kanske försöka räkna ut ett väntevärde för felfrekvensen, med konfidensintervall, och sedan fatta beslut baserat på detta? Så fort man får konfidensintervallet (som kommer att bli stort) kommer man ju att kunna värdera data mycket bättre än om man tar ett panikbeslut direkt efter olyckan.

Antag att vi bara byggt en reaktor (och felet egentligem var något väldigt osannolikt). Vad säger statistiken då om man inte låter folk som förstår hur stort urval man behöver innan man kan dra slutsatser ur materialet med någon form av säkerhet?

Fattas det ett "...styra över beslutet", på slutet?

Att gemene man inte tolkar data rätt är ju liksom rätt självklart. De ser man ju bara man tittar på hur folk spelar på rouletten när det varit sju svarta i rad. MASSOR av satsningar på rött. Ty - att det skall bli svart åtta gånger i rad är ju inte troligt! Eller är det det...

Vh, iö

idea skrev:Svar: Folk har rätt - det är högst osannolikt att det blir svart 8 gånger i rad MEN det är ju fel modell de använder om de baserar sin framtida satsning på den statistiska modellen.

Svante skrev:Nattlorden skrev:Svante skrev:Men säg att man bara har en olycka. Säg att vi hade lyckats göra fusionskraft och lyckats köra den i femtio år med en enda olycka.

Ska man helt ignorera kunskapen det kan ge eller ska man kanske försöka räkna ut ett väntevärde för felfrekvensen, med konfidensintervall, och sedan fatta beslut baserat på detta? Så fort man får konfidensintervallet (som kommer att bli stort) kommer man ju att kunna värdera data mycket bättre än om man tar ett panikbeslut direkt efter olyckan.

Antag att vi bara byggt en reaktor (och felet egentligem var något väldigt osannolikt). Vad säger statistiken då om man inte låter folk som förstår hur stort urval man behöver innan man kan dra slutsatser ur materialet med någon form av säkerhet?

Nu ska vi se om jag förstår den sista meningen; Statistiken säger det den säger oavsett vem som drar slutsatser av den. Men det var nog inte det du menade. Menar du att det är lätt att dra fel slutsatser? Så är det nog. Min poäng är att även ett konfidensintervall behöver tas fram, och om man bara förstår vad ett konfidensintervall är och om man ser hur stort det blir så är det lättare att dra rimliga slutsatser. Alltså; problemet är inte att man drar slutsatser av en begränsad mängd data, problemet är att man drar fel slutsatser och framför allt inte tillåter sig se hur lite information som ligger i ett få-olycke-underlag.

IngOehman skrev:Problemet är att de inte ser frågan ställd på rätt sätt. De missar "om det redan blivit det sju gånger". Statistiken, det man spelar på är ju inte åtta gånger i rad, utan den åttonde gången. Bara den.

IngOehman skrev:Svante skrev:Nu ska vi se om jag förstår den sista meningen; Statistiken säger det den säger oavsett vem som drar slutsatser av den. Men det var nog inte det du menade. Menar du att det är lätt att dra fel slutsatser? Så är det nog. Min poäng är att även ett konfidensintervall behöver tas fram, och om man bara förstår vad ett konfidensintervall är och om man ser hur stort det blir så är det lättare att dra rimliga slutsatser. Alltså; problemet är inte att man drar slutsatser av en begränsad mängd data, problemet är att man drar fel slutsatser och framför allt inte tillåter sig se hur lite information som ligger i ett få-olycke-underlag.

Fast är inte den sista meningen i varje fall lite motsägelsefull?

Eller menar du med den första delen att det ibland behöver tas beslut även utan någon data alls, och att det ju inte är fel?

Isåfall håller jag förstås med dig.

IngOehman skrev:Njae... dels är ju atmosfär något relativt. Men framförallt; det är väldigt svår att under återinträdet inte under någon etapp passera ljudvallen.

Alldeles bortsett ifrån det så tror jag på konceptet. Det blir typ samma restid oavsett vart i världen man styr kosan.Svante skrev:IngOehman skrev:..."man kan se" dina inlägg Svante, där du ständigt vill ha rätt mot iö och aldrig säger att du haft fel ens när du ändrar uppfattning, som ett tecken på att du har dålig självkänsla.

Är det så du ser det?

Nej, för mig är ditt beteende bara ett stort mysterium, men andra har föreslagit nämnd förklaringsmodell.

IngOehman skrev:Att gemene man inte tolkar data rätt är ju liksom rätt självklart. De ser man ju bara man tittar på hur folk spelar på rouletten när det varit sju svarta i rad. MASSOR av satsningar på rött. Ty - att det skall bli svart åtta gånger i rad är ju inte troligt! Eller är det det...

IngOehman skrev:Problemet är att de inte ser frågan ställd på rätt sätt. De missar "om det redan blivit det sju gånger". Statistiken, det man spelar på är ju inte åtta gånger i rad, utan den åttonde gången. Bara den.

IngOehman skrev:Men trots det tror jag vi är väldigt olika benägna att spela på roulette...

IngOehman skrev:...

När jag och Peter Steindl var i Las Vegas så drog jag en jackpot, och slösade omedelbart bort pengarna på att flyga helikopter till Grand Canyon och dricka champagne på dess botten. Vunna pengar bör slösas bort.

...

IngOehman skrev:IngOehman skrev:Nattlorden skrev:

Antag att vi bara byggt en reaktor (och felet egentligem var något väldigt osannolikt). Vad säger statistiken då om man inte låter folk som förstår hur stort urval man behöver innan man kan dra slutsatser ur materialet med någon form av säkerhet?

Fattas det ett "...styra över beslutet", på slutet?

Att gemene man inte tolkar data rätt är ju liksom rätt självklart. De ser man ju bara man tittar på hur folk spelar på rouletten när det varit sju svarta i rad. MASSOR av satsningar på rött. Ty - att det skall bli svart åtta gånger i rad är ju inte troligt! Eller är det det...

Vh, iöidea skrev:Svar: Folk har rätt - det är högst osannolikt att det blir svart 8 gånger i rad MEN det är ju fel modell de använder om de baserar sin framtida satsning på den statistiska modellen.

Det är inget fel på modellen, bara på var man är i händelsen. Folk har fel. Det är inte alls speciellt osannolik att det blir svart en åttonde gång, om det redan blivit det sju gånger.

Hälften av gångerna (nästan) som det blir svart sju gånger så blir det det även den åttonde gången hjulet snurras.

Problemet är att de inte ser frågan ställd på rätt sätt. De missar "om det redan blivit det sju gånger". Statistiken, det man spelar på är ju inte åtta gånger i rad, utan den åttonde gången. Bara den.

Vh, iö

Svante skrev:IngOehman skrev:Att gemene man inte tolkar data rätt är ju liksom rätt självklart. De ser man ju bara man tittar på hur folk spelar på rouletten när det varit sju svarta i rad. MASSOR av satsningar på rött. Ty - att det skall bli svart åtta gånger i rad är ju inte troligt! Eller är det det...

Lustigt, om någon tvingade mig att satsa intill ett rouletthjul och de sju svarta var den enda informationen jag hade så skulle jag satsa på svart. Normalt är ju p(röd)=p(svart), men om data tyder på något så är det ju att p(röd)<p(svart). Rouletthjulet kan ju vara riggat. Och är det inte det så är ju svart lika bra som rött.

DQ-20 skrev:Men grejen i det här fallet är inte bara att bedöma sannolikheten för att få ytterligare en svart utan också vad andra satsar på samma färg eftersom vinsten beror på hur många som satsar på en viss färg. Väl? Då ser man att väntevärdet på pengavinsten är mycket större om man satsar på svart efter sju svarta i rad än om man satsar på rött. => Satsa på svart.

DQ-20 skrev:Svante skrev:IngOehman skrev:Att gemene man inte tolkar data rätt är ju liksom rätt självklart. De ser man ju bara man tittar på hur folk spelar på rouletten när det varit sju svarta i rad. MASSOR av satsningar på rött. Ty - att det skall bli svart åtta gånger i rad är ju inte troligt! Eller är det det...

Lustigt, om någon tvingade mig att satsa intill ett rouletthjul och de sju svarta var den enda informationen jag hade så skulle jag satsa på svart. Normalt är ju p(röd)=p(svart), men om data tyder på något så är det ju att p(röd)<p(svart). Rouletthjulet kan ju vara riggat. Och är det inte det så är ju svart lika bra som rött.

Jag skulle tänka såhär. Sannolikheten att rouletthjulet är "riggat" är ytterst liten och sannolikheten för att får sju svarta i rad beroende på slumpen är större än att hjulet är riggat. Jag antar därför att utfallet beror på slumpen. Men grejen i det här fallet är inte bara att bedöma sannolikheten för att få ytterligare en svart utan också vad andra satsar på samma färg eftersom vinsten beror på hur många som satsar på en viss färg. Väl? Då ser man att väntevärdet på pengavinsten är mycket större om man satsar på svart efter sju svarta i rad än om man satsar på rött. => Satsa på svart.

/DQ-20

PerStromgren skrev:DQ-20 skrev:Men grejen i det här fallet är inte bara att bedöma sannolikheten för att få ytterligare en svart utan också vad andra satsar på samma färg eftersom vinsten beror på hur många som satsar på en viss färg. Väl? Då ser man att väntevärdet på pengavinsten är mycket större om man satsar på svart efter sju svarta i rad än om man satsar på rött. => Satsa på svart.

Nej, du får insatsen plus lika mycket om du satsat på svart och svart kommer upp.

petersteindl skrev:Jag satsar på nollan

idea skrev:IngOehman skrev:IngOehman skrev:Fattas det ett "...styra över beslutet", på slutet?

Att gemene man inte tolkar data rätt är ju liksom rätt självklart. De ser man ju bara man tittar på hur folk spelar på rouletten när det varit sju svarta i rad. MASSOR av satsningar på rött. Ty - att det skall bli svart åtta gånger i rad är ju inte troligt! Eller är det det...

Vh, iöidea skrev:Svar: Folk har rätt - det är högst osannolikt att det blir svart 8 gånger i rad MEN det är ju fel modell de använder om de baserar sin framtida satsning på den statistiska modellen.

Det är inget fel på modellen, bara på var man är i händelsen. Folk har fel. Det är inte alls speciellt osannolik att det blir svart en åttonde gång, om det redan blivit det sju gånger.

Hälften av gångerna (nästan) som det blir svart sju gånger så blir det det även den åttonde gången hjulet snurras.

Problemet är att de inte ser frågan ställd på rätt sätt. De missar "om det redan blivit det sju gånger". Statistiken, det man spelar på är ju inte åtta gånger i rad, utan den åttonde gången. Bara den.

Vh, iö

Du säger ju själv att folk använder fel statisk modell "..de ser inte frågan ställd på rätt sätt". Men måste man alltid ha rätt så måste man..

DQ-20 skrev:PerStromgren skrev:DQ-20 skrev:Men grejen i det här fallet är inte bara att bedöma sannolikheten för att få ytterligare en svart utan också vad andra satsar på samma färg eftersom vinsten beror på hur många som satsar på en viss färg. Väl? Då ser man att väntevärdet på pengavinsten är mycket större om man satsar på svart efter sju svarta i rad än om man satsar på rött. => Satsa på svart.

Nej, du får insatsen plus lika mycket om du satsat på svart och svart kommer upp.

Vilket jävla skitspel!

IngOehman skrev:DQ-20 skrev:PerStromgren skrev:

Nej, du får insatsen plus lika mycket om du satsat på svart och svart kommer upp.

Vilket jävla skitspel!

Inte alls. Det är ett utmärkt spel!

För Casinot.

...

petersteindl skrev:Jag satsar på nollan

IngOehman skrev:Det beror på det.

Men mäter man per varv, och utdelning sker enligt grundreglerna för respektive typ, så ja.

Mäter man på annat sätt så kan man komma fram till nästan vad som helst. Spelar spelaren oändligt länge, det vill säga tills pengarna tar slut, så blir det ju liksom 100% till kasinot, oavsett hur många nollor de har på bordet, och runt det.

IngOehman skrev:I själva verket är slumpbruset rätt så stort, och oddsen att ligga på plus efter ett varv är nästan 50%.

idea skrev: Dvs de använder fel statistisk modell i sitt beslutsfattande.

Svante skrev:Ju mer jag håller på med sånt här, desto mer fascinerad blir jag av hur människan ser på slump. Man kan ju tycka att evolutionen borde ha rustat oss för att hantera slumpen bättre.

Eller är det kanske så att evolutionen faktiskt har optimerat oss, men inte för maximal genomsnittlig individlycka utan för att några få ska få mycket lycka. De kanske bara är de med mycket lycka som har fått fortplanta sig. Och då blir det nödvändigt att chansa, trots att det för 90 % av de som chansar blir dåligt. 10 % får ju ändå föra sina gener vidare. I en population där ingen chansar kanske alla dör.

Vi ser till individens genomsnittliga nytta när vi resonerar logiskt och väntevärdesmässigt, evolutionen "ser" till artens nytta.

Svante skrev:idea skrev: Dvs de använder fel statistisk modell i sitt beslutsfattande.

Nej, precis, det är fel modell att använda, men modellen är riktig för det den gäller för.

Alltså,

En riktig, men inte applicerbar modell här är att sannolikheten för 8 svarta i rad är 1/256

En annan riktig och appllicerbar modell är att sannolikheten för 7 rätt i rad är 1/128, har man redan fått 7 rätt i rad är sannolikheten för att få den 8:e svart (1/256)/(1/128)=1/2.

En annan riktig och applicerbar modell bygger på insikten om oberoende händelser, och då ignorerar man helt de sju första och inser att sannolikheten att få svart i ett snurr är 1/2.

(Fö bygger även modell 2 på att händelserna är oberoende)

(Ovanstående bortser från nollorna.)

idea skrev:Om du inte redan läst "Kahneman - Tänka, snabbt och långsamt" så kan den rekommenderas. Det står en hel del intressant om beslutsteori och riskanalys - att man hellre vill undvika förluster än få vinst tex.

Detta är något av det som styr "folk" när man använder fel statisk modell i sitt beslutsfattande. Sen får ju gärna Ingenjörn kalla det att "folk tänker fel", för på ett plan gör de ju det men de har faktiskt rätt i att 8 svart i rad ÄR osannolikt men det är inte det som skall styra beslutet hur man satsar i en given situation (som Ingenjörn mycket riktigt påvisar). Dvs de använder fel statistisk modell i sitt beslutsfattande. Jag förstår inte vad som är så kontroversiellt i att erkänna det påståendet.

Almen skrev:Svante skrev:Ju mer jag håller på med sånt här, desto mer fascinerad blir jag av hur människan ser på slump. Man kan ju tycka att evolutionen borde ha rustat oss för att hantera slumpen bättre.

Eller är det kanske så att evolutionen faktiskt har optimerat oss, men inte för maximal genomsnittlig individlycka utan för att några få ska få mycket lycka. De kanske bara är de med mycket lycka som har fått fortplanta sig. Och då blir det nödvändigt att chansa, trots att det för 90 % av de som chansar blir dåligt. 10 % får ju ändå föra sina gener vidare. I en population där ingen chansar kanske alla dör.

Vi ser till individens genomsnittliga nytta när vi resonerar logiskt och väntevärdesmässigt, evolutionen "ser" till artens nytta.

Nej, jag tror man fortfarande i stort formulerar det så att evolutionen verkar på individnivå.

IngOehman skrev:Svante skrev:idea skrev: Dvs de använder fel statistisk modell i sitt beslutsfattande.

Nej, precis, det är fel modell att använda, men modellen är riktig för det den gäller för.

Alltså,

En riktig, men inte applicerbar modell här är att sannolikheten för 8 svarta i rad är 1/256