Moderator: Redaktörer

VintageHiFi skrev:Vad definierar du som mikrodetaljer?

Calleberg skrev:https://shop.electrolux.se/matlagning/mikrovagsugnar/c/20084

LeifB skrev:Har fått för mig att lätta koner har lättare för att ge mest mikrodetaljer. Har jag missat något eller fått detta helt åt helsike?

LeifB skrev:VintageHiFi skrev:Vad definierar du som mikrodetaljer?

De små detaljerna som kommer fram tydligt när du lyssnar. Helst utan distorsion. Har svårt att definierar det tydligare. När du hör dom är det som att höra på själen i musiken. De brukar få håret att resa på sig.

Alla tunga koner är usla på detta vad jag har upptäckt.

Kanske en driver med låg massa kopplat till ett horn kan återge de små mikrodetaljerna.

Har inte lyssnat så mycke på dom.

VintageHiFi skrev:LeifB skrev:VintageHiFi skrev:Vad definierar du som mikrodetaljer?

De små detaljerna som kommer fram tydligt när du lyssnar. Helst utan distorsion. Har svårt att definierar det tydligare. När du hör dom är det som att höra på själen i musiken. De brukar få håret att resa på sig.

Alla tunga koner är usla på detta vad jag har upptäckt.

Kanske en driver med låg massa kopplat till ett horn kan återge de små mikrodetaljerna.

Har inte lyssnat så mycke på dom.

Tänkte lite på det element du anger i ditt första inlägg.

Borde det inte vara svårare att få dessa mikrodetaljer att framträda tydligt om man har ett enda element som ska återge hela tonområdet.

Detta enda element ska ju återger hela tonområdet från djupaste bas till hösta diskant.

Ett sånt element är ju en rejäla kompromiss & egentligen inte riktigt bra på något vilket borde ge sämre förutsättningar för att höra det du eftersträvar.

Elementet är ju egentligen litet & klent för att återge basen samt alldeles för stort & tungt för att återge diskanten på bästa sätt.

RogerGustavsson skrev:Om du tror låg massa är viktig får du väl gå på elektrostater. Vid lägre frekvenser lär du nog inte höra den höga massan hos konventionella konelement oavsett.

RogerGustavsson skrev:Nej, tvärtom! Plastfilmen i elektrostater är 3-6 µm tjock, 4-8 gram per kvadratmeter. Membranen är sedan indelade i mindre sektioner så det blir inte mycket ens ibasen.

Bandelement finns det olika typer av, de med aluminium på plastfilm och de som bara är aluminium. Stora basmembran som t.ex. finns på Apogee har ofta en rörlig massa 25-40 gram. Det gäller även Magnepans basmembran.

LeifB skrev:När det gäller banddiskanter med låg vikt finns det några att välja på. Fountek har några olika.

LeifB skrev:RogerGustavsson skrev:Nej, tvärtom! Plastfilmen i elektrostater är 3-6 µm tjock, 4-8 gram per kvadratmeter. Membranen är sedan indelade i mindre sektioner så det blir inte mycket ens ibasen.

Bandelement finns det olika typer av, de med aluminium på plastfilm och de som bara är aluminium. Stora basmembran som t.ex. finns på Apogee har ofta en rörlig massa 25-40 gram. Det gäller även Magnepans basmembran.

Var delas basen på Apogee och Magnepans högtalare på fekvensen?

LeifB skrev:Jag tror inte att de flesta förstår vad konens och membranets vikt påverkar ljudet.

Vad tror ni?

Morello skrev:Den rörliga massan påverkar, i det massakontrollerade området, verkningsgraden givet konstant BL-produkt.

Det noteras att det i tråden förekommer allehanda myter angående massans påverkan på distorsion etc.

petersteindl skrev:Tyngdkraften? Hur menar du att den kommer in? Tyngd, eller tyngdkraft, är en kraft som verkar på kroppar i ett gravitationsfält. Enligt Newtons gravitationslag attraherar alla massor i universum varandra med den så kallade gravitationskraften. Med tyngdkraft menas i detta sammanhang (vektor-)summan av gravitationskraften och den centrifugalkraft som orsakas av att jorden roterar.

”Liten massa rör sig snabbare” skriver du. Är ditt ordval ’snabbare’ relaterat till hastighet eller till acceleration, menar du?

Vill du på något sätt relatera till ekvationen F=m*a.

idea skrev:F = m x a eller a = F / m (accelerationen = Kraften / massan) dvs ju mer massa desto större kraft behöver du för samma acceleration. Så tyngre kon kräver större 'motor' för samma respons. Så att en lätt kon ger inte bättre respons per definition utan det beror som vanligt på andra parametrar också.

LeifB skrev:petersteindl skrev:Tyngdkraften? Hur menar du att den kommer in? Tyngd, eller tyngdkraft, är en kraft som verkar på kroppar i ett gravitationsfält. Enligt Newtons gravitationslag attraherar alla massor i universum varandra med den så kallade gravitationskraften. Med tyngdkraft menas i detta sammanhang (vektor-)summan av gravitationskraften och den centrifugalkraft som orsakas av att jorden roterar.

”Liten massa rör sig snabbare” skriver du. Är ditt ordval ’snabbare’ relaterat till hastighet eller till acceleration, menar du?

Vill du på något sätt relatera till ekvationen F=m*a.

Den ekvation är välkänd.

En lättare massa har lättare att röra på sig.

idea skrev:LeifB skrev:petersteindl skrev:Tyngdkraften? Hur menar du att den kommer in? Tyngd, eller tyngdkraft, är en kraft som verkar på kroppar i ett gravitationsfält. Enligt Newtons gravitationslag attraherar alla massor i universum varandra med den så kallade gravitationskraften. Med tyngdkraft menas i detta sammanhang (vektor-)summan av gravitationskraften och den centrifugalkraft som orsakas av att jorden roterar.

”Liten massa rör sig snabbare” skriver du. Är ditt ordval ’snabbare’ relaterat till hastighet eller till acceleration, menar du?

Vill du på något sätt relatera till ekvationen F=m*a.

Den ekvation är välkänd.

En lättare massa har lättare att röra på sig.

Jo men det är kraften som får den att röra sig. Utan kraft står den stilla oavsett hur lätt den är.

LeifB skrev:idea skrev:LeifB skrev:

Den ekvation är välkänd.

En lättare massa har lättare att röra på sig.

Jo men det är kraften som får den att röra sig. Utan kraft står den stilla oavsett hur lätt den är.

Så sant. Det måste till kraft.

LeifB skrev:petersteindl skrev:Tyngdkraften? Hur menar du att den kommer in? Tyngd, eller tyngdkraft, är en kraft som verkar på kroppar i ett gravitationsfält. Enligt Newtons gravitationslag attraherar alla massor i universum varandra med den så kallade gravitationskraften. Med tyngdkraft menas i detta sammanhang (vektor-)summan av gravitationskraften och den centrifugalkraft som orsakas av att jorden roterar.

”Liten massa rör sig snabbare” skriver du. Är ditt ordval ’snabbare’ relaterat till hastighet eller till acceleration, menar du?

Vill du på något sätt relatera till ekvationen F=m*a.

Den ekvation är välkänd.

En lättare massa har lättare att röra på sig.

LeifB skrev:idea skrev:F = m x a eller a = F / m (accelerationen = Kraften / massan) dvs ju mer massa desto större kraft behöver du för samma acceleration. Så tyngre kon kräver större 'motor' för samma respons. Så att en lätt kon ger inte bättre respons per definition utan det beror som vanligt på andra parametrar också.

Har ett 20-tal olika element. Den lättaste rör sig lättast.

Motorn är stark. Massan låg. 5 gram. SD 85cm2 Max linjär slaglängd +- 7 mm

VintageHiFi skrev:LeifB skrev:idea skrev:

Jo men det är kraften som får den att röra sig. Utan kraft står den stilla oavsett hur lätt den är.

Så sant. Det måste till kraft.

Hur resonerar du kring valet av element?

Ett element som inte är särskilt bra på något kontra att använda flera element som kan jobba inom en

snävare men mer specialiserat område.

Om du skulle lyssna på bredbandselementet du nämnde i fösta inlägget för att avgöra hur det låter i det

övre registret ställt mot att du gör samma lyssning på ett mindre diskantelement inom samma tonområde.

Gör du sedan om samma sak i basområdet bredbandselementet mot ett baselement.

Sen samma sak igen bredbandselementet mot ett mellanregisterelement.

Vilket element tror skulle göra bästa jobbet inom de olika områdena?

petersteindl skrev:LeifB skrev:idea skrev:F = m x a eller a = F / m (accelerationen = Kraften / massan) dvs ju mer massa desto större kraft behöver du för samma acceleration. Så tyngre kon kräver större 'motor' för samma respons. Så att en lätt kon ger inte bättre respons per definition utan det beror som vanligt på andra parametrar också.

Har ett 20-tal olika element. Den lättaste rör sig lättast.

Motorn är stark. Massan låg. 5 gram. SD 85cm2 Max linjär slaglängd +- 7 mm

Vilket högtalarelement är detta?

LeifB skrev:Jag har provat olika element.

Har fått för mig att lätta koner har lättare för att ge mest mikrodetaljer.

JM skrev:LeifB skrev:Jag har provat olika element.

Har fått för mig att lätta koner har lättare för att ge mest mikrodetaljer.

Bra fråga!

Detaljupplevelsen har en fysikalisk sida men även en fysiologisk och psykologisk sida som i hög grad påverkar.

I fysikens värld är det ffa vissa stimuli av hörseln som avgör detaljrikedomen:

- Distorsionen

- Frekvenskurvan

- Ljudintensiteten

I fysiologins/psykologins värld optimeras upplevd detaljrikedomen i direktljudet ffa av:

- Optimal ljudstyrka (75-80 dB) hos direktljudet. Vid för låg/hög ljudstyrka hos direktljudet maskeras svaga ljud av starkare på olika sätt.

- Optimala reflexer. Optimala reflexer ger fler detaljer i direktljudet än vid inga reflexer alls. Ooptimala reflexer maskerar detaljer i direktljudet.

- Musikens "täthet". Ju glesare ej så lågfrekvent direktljud desto färre maskerande ljud och därmed upplevs fler detaljer i direktljudet.

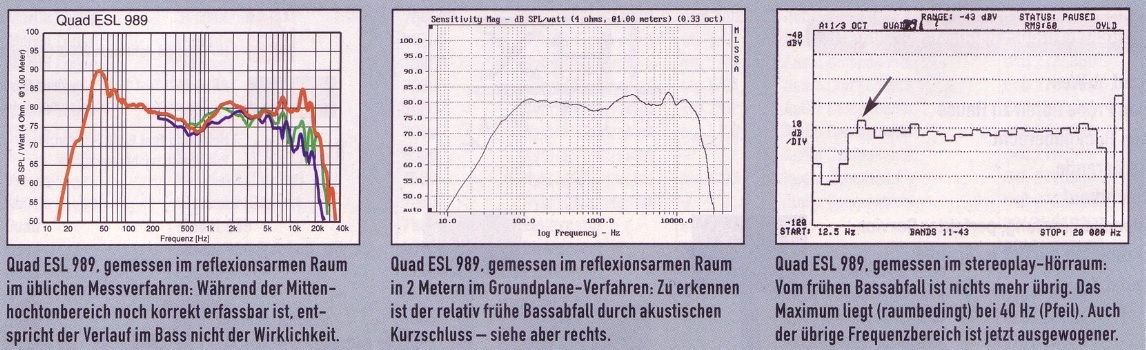

Personligen har jag Yamaha NS-1000 (lätta beryllium diskanter/mellanregister - lådhgt) och Apogee Duetta (lätta band - dipol) båda med ca 0,1 % distorsion vid 90 dB. Där Apogee högtalarens optimala reflexer ger fler detaljer trots samma distorsionsvärden i samma rum med samma musik och ljudnivå. Även mina Quad 989 elektrostater gav fler detaljer med liknande låga distorsions värden i samma rum.

Dipolerna ger ej diffusare ljud än lådhgt, snarare tvärtom, distinktare spatial spridning med fler detaljer. Det är en myt att optimala dipoler ger diffust ljud.

Klart spännande att återigen lyssna på gamla CD/LP efter typ 30 år där helt nya detaljer uppenbar sig trots att jag tappat den högsta diskanten.

JM

LeifB skrev:Läste om en recension av Magnepan LRS.

Det var extremt viktigt att ställa upp dom rätt.

Fel uppställda kunde de låta hårt och diskanten var inte i fas med basen. Invinklingen gjorde stor skillnad på ljudet. Iallafall så hade väldigt gott om mikrodetaljer och det berodde på deras uppbyggnad och sitt lätta membran. Distorsionen är låg.

RogerGustavsson skrev:LeifB skrev:Läste om en recension av Magnepan LRS.

Det var extremt viktigt att ställa upp dom rätt.

Fel uppställda kunde de låta hårt och diskanten var inte i fas med basen. Invinklingen gjorde stor skillnad på ljudet. Iallafall så hade väldigt gott om mikrodetaljer och det berodde på deras uppbyggnad och sitt lätta membran. Distorsionen är låg.

Nja, speciellt låg massa har inte membranen. Det är en felaktig föreställning som ofta förekommer. Distorsion brukar vara hög i basen ju mindre modellen är. Det går inte att rucka på naturlagar hur som helst.

RogerGustavsson skrev:LeifB skrev:RogerGustavsson skrev:Nja, speciellt låg massa har inte membranen. Det är en felaktig föreställning som ofta förekommer. Distorsion brukar vara hög i basen ju mindre modellen är. Det går inte att rucka på naturlagar hur som helst.

Så de är inte lätta?

Basen går inte mycket lägre än 50hz.

LRS är lite annorlunda uppbyggd än SMG.

Nej, varför tror alla som gör recensioner det? Bas och diskant på samma membran.Tråden blir inte lättare för att den är platt.

Undrar om de ens når så långt ner. Skulle snarare säga faller brant under 65-70 Hz. Tuff last för slutstegen.

Imperial-Blomman skrev:Alpair CHP-90 ser ut att vara en trevlig högtalare.

Fri från distorsion! Njae de e dom nog inte.

Men de krävs mätning för att avgöra det.

Men passar dom dina öron så ere ju skit bra.

De e trevligt när folk hittar rätt.

Gillar du högtalarna som dom e så ere bara å skita

i distorsionen som e å lira musik istället för å tänka på det.

Kraniet skrev:Jag skulle tro att det som normalt benämns "mikrodetaljer" är olika former av distorsion.

Men är man nöjd med det så är det ju godartad distorsion

pLudio skrev:Jag kan bara konstatera att jag behöver uppgradera till berylliumdiskanter.

LeifB skrev:pLudio skrev:Jag kan bara konstatera att jag behöver uppgradera till berylliumdiskanter.

Inte säkert, har du inget annan orsak att du saknar microdetaljer?

RogerGustavsson skrev:Undrar fortfarande vad som avses med mikrodetaljer. Är det ett bestämt frekvensområde som åsyftas? Örat är ju känsligt för maskeringseffekter. Brakar det på i ett område hör man det svagare i ett annat.

LeifB skrev:RogerGustavsson skrev:Undrar fortfarande vad som avses med mikrodetaljer. Är det ett bestämt frekvensområde som åsyftas? Örat är ju känsligt för maskeringseffekter. Brakar det på i ett område hör man det svagare i ett annat.

Jag har inget svar.

Jag använder mig av Silk 050 som signalkabel.

Har lite andra att jämföra med. Silk 050 framför ett neutralt ljud. Tar fram microdetaljer i musiken med en välartikulerad högtalarelement.

Jag tror den ledande silverpläterade tråden bidrar med det och skärmen som kopplas till den sändande delen. T.e.x. I detta fallet från cd:n. Så jorden (höljet) ska inte komma i kontakt med mottagaren.

jansch skrev:[...]

Oj......

Silk 050 fungerarsäkert utmärkt om "konstruktörerna" inte hittat på nåt "skit" med jordflätan etc. Likaså de flesta s.k "lakritssnören" för en 1/5 del av försäljningspriset. Seriösa tester visar att lakritskablar har lika bra eller BÄTTRE egenskaper än s.k. High end kablar. Väljer man proffskabel från t.ex tillverkaren Belden och liknande "sitter man säkert" och behöver inte bry sig om nån idiot har förstört egenskaperna utan att fatta vad han/hon håller på med.

En vanlig "lakriskabel" har lika mycket "mikrodetaljer" som en 100.000kronors idiotkabel. Allt går att mäta och på en nivå som är flera 10-potenser bättre än något "guldöra", som då dessutom beskriver fysikens lagar med begrepp som "mikrodetaljer" eller "nu hör jag att ljudet från triangeln är mer närvarande".

Alltså, hur svårt kan det vara. Jag tycker också att det är kul med tomten på julafton. Har han flygande renar trots att Newtons lagar säger att det är en omöjlighet. Är det nån som vet?

Fascinerande att kan kan komma ner genom skorstenen (rökkanalen) som är 125mm i diameter. Det kan bara tomten göra....

jansch skrev:Jag tycker också att det är kul med tomten på julafton. Har han flygande renar trots att Newtons lagar säger att det är en omöjlighet. Är det nån som vet?

Fascinerande att kan kan komma ner genom skorstenen (rökkanalen) som är 125mm i diameter. Det kan bara tomten göra....

MacBruce skrev:jansch skrev:[...]

Oj......

Silk 050 fungerarsäkert utmärkt om "konstruktörerna" inte hittat på nåt "skit" med jordflätan etc. Likaså de flesta s.k "lakritssnören" för en 1/5 del av försäljningspriset. Seriösa tester visar att lakritskablar har lika bra eller BÄTTRE egenskaper än s.k. High end kablar. Väljer man proffskabel från t.ex tillverkaren Belden och liknande "sitter man säkert" och behöver inte bry sig om nån idiot har förstört egenskaperna utan att fatta vad han/hon håller på med.

En vanlig "lakriskabel" har lika mycket "mikrodetaljer" som en 100.000kronors idiotkabel. Allt går att mäta och på en nivå som är flera 10-potenser bättre än något "guldöra", som då dessutom beskriver fysikens lagar med begrepp som "mikrodetaljer" eller "nu hör jag att ljudet från triangeln är mer närvarande".

Alltså, hur svårt kan det vara. Jag tycker också att det är kul med tomten på julafton. Har han flygande renar trots att Newtons lagar säger att det är en omöjlighet. Är det nån som vet?

Fascinerande att kan kan komma ner genom skorstenen (rökkanalen) som är 125mm i diameter. Det kan bara tomten göra....

Håller med till 100%. Make it 120%, förresten...Moder Natur skämtar man inte med, inte ens när hon är på gott humör!

MacBruce skrev:jansch skrev:[...]

Oj......

Silk 050 fungerarsäkert utmärkt om "konstruktörerna" inte hittat på nåt "skit" med jordflätan etc. Likaså de flesta s.k "lakritssnören" för en 1/5 del av försäljningspriset. Seriösa tester visar att lakritskablar har lika bra eller BÄTTRE egenskaper än s.k. High end kablar. Väljer man proffskabel från t.ex tillverkaren Belden och liknande "sitter man säkert" och behöver inte bry sig om nån idiot har förstört egenskaperna utan att fatta vad han/hon håller på med.

En vanlig "lakriskabel" har lika mycket "mikrodetaljer" som en 100.000kronors idiotkabel. Allt går att mäta och på en nivå som är flera 10-potenser bättre än något "guldöra", som då dessutom beskriver fysikens lagar med begrepp som "mikrodetaljer" eller "nu hör jag att ljudet från triangeln är mer närvarande".

Alltså, hur svårt kan det vara. Jag tycker också att det är kul med tomten på julafton. Har han flygande renar trots att Newtons lagar säger att det är en omöjlighet. Är det nån som vet?

Fascinerande att kan kan komma ner genom skorstenen (rökkanalen) som är 125mm i diameter. Det kan bara tomten göra....

Håller med till 100%. Make it 120%, förresten...Moder Natur skämtar man inte med, inte ens när hon är på gott humör!

RogerGustavsson skrev:jansch skrev:Jag tycker också att det är kul med tomten på julafton. Har han flygande renar trots att Newtons lagar säger att det är en omöjlighet. Är det nån som vet?

Fascinerande att kan kan komma ner genom skorstenen (rökkanalen) som är 125mm i diameter. Det kan bara tomten göra....

Fast det är väl inte en beskrivning av vår svenske tomte, den där som strök omkring husen och man ställde ut gröt till?

LeifB skrev:...

Måste man tro på tomten? Tveksamt.

...

STDI skrev:Visst är det trevligt att bli tilldelad ett namntillägg som man är stolt över.

LeifB skrev:Vi är så olika. En del tror på tomten fortfarande.

Andra lyssnar på musik och trivs med det.

Måste man tro på tomten? Tveksamt.

Musiken framkallar känslor. En del får julstämning en del längtar till våren. Musik har en förunderlig förmåga att framkalla känslosamma minnen.

Många förknippar låtar med speciella minnen som väcker känslor.

Kan det var mikrodetaljerna som framkalla en del av känslorna, jag tror absolut detta kan vara fallet. Om det låter som sammet för öronen så är vi nära en eargasm.

LeifB skrev:STDI skrev:Visst är det trevligt att bli tilldelad ett namntillägg som man är stolt över.

Ja det är trevligt.

Jag har alltid velat bli trollkarl.

Calleberg skrev:LeifB skrev:STDI skrev:Visst är det trevligt att bli tilldelad ett namntillägg som man är stolt över.

Ja det är trevligt.

Jag har alltid velat bli trollkarl.

Äntligen!

avr7000 skrev:Element som ger mest mikrodetaljer är de som har lägst dist (som då kan släppa fram signalen oanfrätt).

Purifi och Bliesma ligger bra till här.

LeifB skrev:avr7000 skrev:Element som ger mest mikrodetaljer är de som har lägst dist (som då kan släppa fram signalen oanfrätt).

Purifi och Bliesma ligger bra till här.

Intressant, är det ett självklart svar. Håller alla med?

Dyra är dom.

matssvensson skrev:LeifB skrev:avr7000 skrev:Element som ger mest mikrodetaljer är de som har lägst dist (som då kan släppa fram signalen oanfrätt).

Purifi och Bliesma ligger bra till här.

Intressant, är det ett självklart svar. Håller alla med?

Dyra är dom.

Söker du ett objektivt svar gissar jag att många på detta forum skulle hålla med om avr7000 resonemang. Letar du efter något som ger starkare subjektiva upplevelser av mikrodetaljer får du leta lösningar med betoningar som skapar olika typer av förvrängning för att framhäva önskade områden. Alternativt välja högtalarlösningar med stark riktverkan som sätter rumsreflexer ur spel och lyckas skapa en "hörlurseffekt" av närhet i lyssningsupplevelsen.

LeifB skrev:avr7000 skrev:Element som ger mest mikrodetaljer är de som har lägst dist (som då kan släppa fram signalen oanfrätt).

Purifi och Bliesma ligger bra till här.

Intressant, är det ett självklart svar. Håller alla med?

Dyra är dom.

LeifB skrev:avr7000 skrev:Element som ger mest mikrodetaljer är de som har lägst dist (som då kan släppa fram signalen oanfrätt).

Purifi och Bliesma ligger bra till här.

Intressant, är det ett självklart svar. Håller alla med?

Dyra är dom.

LeifB skrev:Ok. Kan högtalare som är vinklade framför din stol vara bättre och avge mer microdetaljer beroende på färre reflexer från omgivningen (rummet).

I-or skrev:Dock kan ett övermått av reflektioner naturligtvis maskera detaljer i ljudet. Detta framgår tydligt av hörlurslyssning (med klangbalanserade lurar som inte framhäver något frekvensområde och skapar en illusion av "falsk" detaljering), där frånvaron av reflektioner och även vanligen den låga distorsionen ger ett hyperdetaljerat ljud. Om man lyssnar på högtalarnas huvudstrålningsaxel så maximeras förhållandet mellan direktljud och reflekterat ljud. En "överinvinklad" uppställning kan ändå ge ett tydligare och mer detaljerat ljud totalt sett eftersom man på så sätt reducerar inverkan från de första sidoväggsreflektionerna. Det bör tilläggas att den bästa lösningen är att placera minst 40 mm tjocka absorbenter på sidoväggarna vid positionen för den första sidoväggsreflektionen och sedan vinkla in högtalarna så att man uppnår en lagom balans för ljudsceneriet (insvepning kontra noggrannhet och detaljeringsgrad). Sedan avslutar man med högfrekvensekvalisering för att balansera klangen i lyssningspositionen (lågfrekvensekvaliseringen bör man göra innan man bestämmer invinklingen).

I-or skrev:Att vinkla in högtalarna mer än att bafflarna är riktade direkt mot lyssningspositionen ger ett mer fokuserat och tydligt ljud speciellt när högtalarnas avstånd till sidoväggarna är kort. Dock brukar det ändå inte fungera helt optimalt, dels för att den första närsidoväggsreflektionen anländer mycket tidigt och ändå är relativt kraftfull, men även för att den första fjärrsidoväggsreflektionen, liksom den första högtalarväggsreflektionen, blir starkare.

Med ett kort avstånd till sidoväggarna blir sidoväggsabsorbenter närmast ofrånkomliga med konventionella högtalare.

I-or skrev:Ett avstånd mindre än ca 1,5 m till sidoväggarna får nog betraktas som kort om lyssningsavståndet är ca 3 m. Detta betyder förstås att man i många uppställningar helst bör utnyttja absorption vid den första sidoväggsreflektionen. Absorptionen kan bestå i t.ex. lite tjockare gardiner/draperier, textila tavlor eller mer utpräglade absorbenter (vilka vanligen är mest effektiva). Även möblemang som ger diffusion, t.ex. bokhyllor, kan vara hyggligt verkningsfullt om införande av absorption inte är praktiskt möjligt.

Om man är ute efter närmast optimala förhållanden vill man undvika kraftiga horisontella reflektioner inom 10 ms (3,4 m extra löpväg) över ca 1 kHz och detta är närmast omöjligt att uppnå utan absorbenter i ett normalt rum.

Fjärrsidoväggen betyder den högra sidoväggen för den vänstra högtalaren och den vänstra sidoväggen för den högra högtalaren.

I-or skrev:Mja, frekvensgången dominerar som vanligt. Om man t.ex. har en topp i mellandiskanten och en dal i den övre basen så kommer ljudet för många lyssnare att framstå som betydligt mer detaljerat - långt mer så än om man sänker distorsionen ordentligt.

I-or skrev:Mja, frekvensgången dominerar som vanligt. Om man t.ex. har en topp i mellandiskanten och en dal i den övre basen så kommer ljudet för många lyssnare att framstå som betydligt mer detaljerat - långt mer så än om man sänker distorsionen ordentligt.

I-or skrev:Exakt. Detta har för övrigt mycket gemensamt med s.k. presning i inspelningssammanhang, vilket man gör för att erhålla ett "klarare" och mer "detaljerat" ljud (d.v.s. en onaturlig klangbalans). Ibland kombinerar man även detta med en dal i den övre basen eller det undre mellanregistret.

Man kan ofta läsa från diverse professionella recensenter när det gäller hörlurar eller BT-högtalare, att produkt si och så har bättre bastryck, men att produkt så och si förvisso är lite tunnare i basen men låter klarare och mer detaljerat.

Almen skrev:I-or skrev:Mja, frekvensgången dominerar som vanligt. Om man t.ex. har en topp i mellandiskanten och en dal i den övre basen så kommer ljudet för många lyssnare att framstå som betydligt mer detaljerat - långt mer så än om man sänker distorsionen ordentligt.

Jo, men sådant tar man väl om hand med ett väldimensionerat filter?

Vad jag menar med "mikrodetaljer", för att ta frågeställningen på allvar, är inte ett onaturligt hissat mellanregister utan de små, små ljud på en inspelning som man bara hör i en anläggning med relativt lågt omgivningsbrus och en högt satt volymkontroll. Det jag i första hand tänker på förekommer nästan uteslutande på rena akustiska inspelningar av riktiga instrumentensembler; pyttelite vibrato eller tremolo på ett stråkinstrument, den sista utringningen av en cymbal eller gran cassa, det svaga gnisslet av fingertoppar som dras längs strängarna på en stålsträngad gitarr, knarret av en stol, fötter som hasar på ett golv, etc., etc..

Eller, för den delen, inspelningar från 1944 gjorda i Berlin där man hör kriget i bakgrunden.

JM skrev:Menar du att all distorsion kan härledas till ej rak uppmätt tonkurva i lyssningspositionen även om direktljudet mäter rakt?

JM

I-or skrev:I det här fallet hävdas en extra hög detaljeringsgrad från ett bredbandselement med kraftigt varierande frekvensgång (och, liksom alla bredbandselement, relativt hög distorsion). Dessa egenskaper är typiska i sammanhanget och utgör nog minst 95 % av de högtalare och hörlurar som påstås uppvisa ett högdetaljerat ljud.

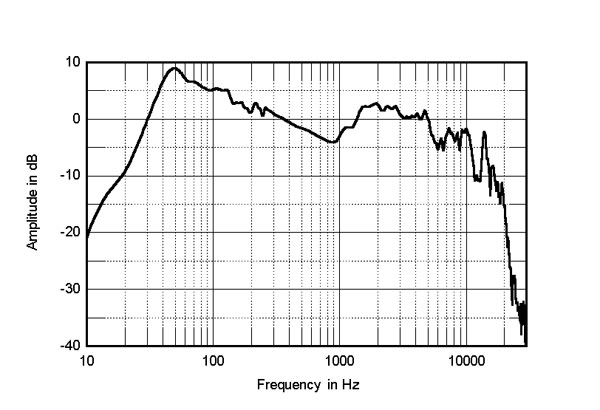

Det är alltså förhållandevis ovanligt med konstant frekvensgång för högtalare som av många tyckare påstås lyfta fram detaljer. I inspelningssammanhang utgör den ökända Yamaha NS10 ett tydligt exempel, då den anses vara ett utmärkt verktyg för att finna små detaljer och felaktigheter i mixen, se frekvensgång nedan:

Den förhöjda nivån i övre mellanregister och diskant kombinerat med avsaknaden av bas reducerar kraftigt maskeringseffekter från grundtonsområdet.

Det är en helt annan sak att en god återgivare lyfter fram exakt de detaljer som ska lyftas fram och ingenting annat. Vissa detaljer ska man helt enkelt inte höra eftersom de maskeras av andra ljud och mer betyder därför inte nödvändigtvis bättre här. En korrekt återgivning, inkluderande precis de detaljer som ska vara hörbara, erhåller man som vanligt via konstant frekvensgång, god spridning och låg distorsion.

I-or skrev:JM skrev:Menar du att all distorsion kan härledas till ej rak uppmätt tonkurva i lyssningspositionen även om direktljudet mäter rakt?

JM

Distorsion* har ingenting med frekvensgång att göra.

*Otyget att hävda att distorsion existerar både i linjär och olinjär form förekommer (som tur är) bara i akademiska sammanhang.

Chris71 skrev:Riskera väl att bli ribba och ut, men om man tar fasta på mikrodetaljerna och förutsättningar för att höra dem så skulle jag slänga in en dark horse: Quad ESL paneler.

Ytan medger ju gott om plats för det mesta utom den djupaste basen, 0,03% dist förutom in de lägsta frekvenserna.

Lägre membranvikt är nog svår att hitta, vill man förfina det ytterligare så får man väl hänga membranen på öronen.

Argumentet för ESL som detaljrika kan ju till viss förklaras med deras förmåga att spela 4-kantsvågor hyfsat väl kontrollerat.

eljulio skrev:ESL 63 har jag faktiskt lyssnat på. Mycket trevlig på rätt volymnivå måste jag säga.

LeifB skrev:eljulio skrev:ESL 63 har jag faktiskt lyssnat på. Mycket trevlig på rätt volymnivå måste jag säga.

Har den låg distorsion?

Alla ska ha element med låg distorsion nu.

Verkar vara medicinen för microdetaljer.

Vad säger alla experter?

Chris71 skrev:Riskera väl att bli ribba och ut, men om man tar fasta på mikrodetaljerna och förutsättningar för att höra dem så skulle jag slänga in en dark horse: Quad ESL paneler.

Ytan medger ju gott om plats för det mesta utom den djupaste basen, 0,03% dist förutom in de lägsta frekvenserna.

Lägre membranvikt är nog svår att hitta, vill man förfina det ytterligare så får man väl hänga membranen på öronen.

Argumentet för ESL som detaljrika kan ju till viss förklaras med deras förmåga att spela 4-kantsvågor hyfsat väl kontrollerat.

VintageHiFi skrev:LeifB skrev:eljulio skrev:ESL 63 har jag faktiskt lyssnat på. Mycket trevlig på rätt volymnivå måste jag säga.

Har den låg distorsion?

Alla ska ha element med låg distorsion nu.

Verkar vara medicinen för microdetaljer.

Vad säger alla experter?

Så slutstaten är att högtalare med en viss typ av olinjär i frekvensgången är att föredra för dom som söker högtalarelement med det dom kallar "mycket mikrodetaljer"

Det innebär att lite pillade på en GEQ/PEQ skulle kunna tillgodose lyssnaren med det dom söker.

VintageHiFi skrev:Så slutstaten är att högtalare med en viss typ av olinjär i frekvensgången är att föredra för dom som söker högtalarelement med det dom kallar "mycket mikrodetaljer"

Det innebär att lite pillade på en GEQ/PEQ skulle kunna tillgodose lyssnaren med det dom söker.

Morello skrev:Hur är det med nanodetaljåtergivningen?

Belker skrev:Morello skrev:Hur är det med nanodetaljåtergivningen?

Bra fråga! Fast egentligen är väl LeifB et al ute efter megadetaljer. Eller Quetta!

JM skrev:När det gäller att höra detaljer är vi på den psykologiska planhalvan. För den som inte är invig i fysikens vindlingar är upplevelsen av detaljer ett sätt att rangordna tex högtalare. Tool och Olive rangordnade högtalare i en stor (med avseende på antalet deltagande försökspersoner) hyfsad dubbel blindstudie map detaljer i vid bemärkelse. Att det inte går att själv att i det enskilda fallet rangordna högtalare är inte helt lätt att ta till sig. Ändå gör vi subjektiva bedömningar regelbundet fast rangordningen inte har något värde trots att det känns så.

JM

Nattlorden skrev:Mikrodetaljer hörs lättast när kompression föreligger.

petersteindl skrev:Jag ser inte kompression som ett sätt att höra mikrodetaljer. Jag menar, detaljerna blir ju inte längre detaljer.

Bill50x skrev:petersteindl skrev:Jag ser inte kompression som ett sätt att höra mikrodetaljer. Jag menar, detaljerna blir ju inte längre detaljer.

Nä. Men det känns som att man hör saker man inte hört tidigare och därför tror man att det är "mikrodetaljer".

/ B

petersteindl skrev:Bill50x skrev:petersteindl skrev:Jag ser inte kompression som ett sätt att höra mikrodetaljer. Jag menar, detaljerna blir ju inte längre detaljer.

Nä. Men det känns som att man hör saker man inte hört tidigare och därför tror man att det är "mikrodetaljer".

/ B

Fast det är inte samma sak. Antingen hör man mikrodetaljer eller också inte, fast man tror att det är mikrodetaljer.

petersteindl skrev:Vill man titta på mikrodetaljer på bild så zoomar man in.

Vill man höra mikrodetaljer i ljud, så zoomar man in.

petersteindl skrev:Bill50x skrev:petersteindl skrev:Jag ser inte kompression som ett sätt att höra mikrodetaljer. Jag menar, detaljerna blir ju inte längre detaljer.

Nä. Men det känns som att man hör saker man inte hört tidigare och därför tror man att det är "mikrodetaljer".

Fast det är inte samma sak. Antingen hör man mikrodetaljer eller också inte, fast man tror att det är mikrodetaljer.

Säg att du är på konsert och du sitter långt bak i konserthuset.

Nu vill du höra mer mikrodetaljer från insterument och sångare. Hur gör du då?

Almen skrev:petersteindl skrev:Bill50x skrev:Nä. Men det känns som att man hör saker man inte hört tidigare och därför tror man att det är "mikrodetaljer".

/ B

Fast det är inte samma sak. Antingen hör man mikrodetaljer eller också inte, fast man tror att det är mikrodetaljer.

Ja, jag håller med. Förekomsten av missuppfattningar om vad mikrodetaljer är borde inte leda till felaktig användning av termen ifråga.

juanth skrev:Almen skrev:petersteindl skrev:

Fast det är inte samma sak. Antingen hör man mikrodetaljer eller också inte, fast man tror att det är mikrodetaljer.

Ja, jag håller med. Förekomsten av missuppfattningar om vad mikrodetaljer är borde inte leda till felaktig användning av termen ifråga.

Alla pratar om mikrodetaljer som om alla har en uppfattning om vad det är. (Förutom de som definitivt larvar sig) Är det en term som ni kan förklara?

Är det upplösning? Är det avsaknad av distorsion?

Det här är en väldigt ofaktiskt.io och flummig tråd måste jag säga.

Almen skrev:Vad jag menar med "mikrodetaljer", för att ta frågeställningen på allvar, är inte ett onaturligt hissat mellanregister utan de små, små ljud på en inspelning som man bara hör i en anläggning med relativt lågt omgivningsbrus och en högt satt volymkontroll. Det jag i första hand tänker på förekommer nästan uteslutande på rena akustiska inspelningar av riktiga instrumentensembler; pyttelite vibrato eller tremolo på ett stråkinstrument, den sista utringningen av en cymbal eller gran cassa, det svaga gnisslet av fingertoppar som dras längs strängarna på en stålsträngad gitarr, knarret av en stol, fötter som hasar på ett golv, etc., etc..

Almen skrev:juanth skrev:Almen skrev:Ja, jag håller med. Förekomsten av missuppfattningar om vad mikrodetaljer är borde inte leda till felaktig användning av termen ifråga.

Alla pratar om mikrodetaljer som om alla har en uppfattning om vad det är. (Förutom de som definitivt larvar sig) Är det en term som ni kan förklara?

Är det upplösning? Är det avsaknad av distorsion?

Det här är en väldigt ofaktiskt.io och flummig tråd måste jag säga.

Då repeterar jag mitt försök att tydliggöra vad jag menar (tidigare i tråden):Almen skrev:Vad jag menar med "mikrodetaljer", för att ta frågeställningen på allvar, är inte ett onaturligt hissat mellanregister utan de små, små ljud på en inspelning som man bara hör i en anläggning med relativt lågt omgivningsbrus och en högt satt volymkontroll. Det jag i första hand tänker på förekommer nästan uteslutande på rena akustiska inspelningar av riktiga instrumentensembler; pyttelite vibrato eller tremolo på ett stråkinstrument, den sista utringningen av en cymbal eller gran cassa, det svaga gnisslet av fingertoppar som dras längs strängarna på en stålsträngad gitarr, knarret av en stol, fötter som hasar på ett golv, etc., etc..

Min definition har alltså i sig ingenting med tekniska lösningar eller mätningar att göra.

Morgan skrev:Jag är lite förvånad över att ingen ställt den mer intressanta frågan: Vilka lyssningsrum ger mest microdetaljer.

Om man spelar musik i ett rum med lång efterklang och mycket tidiga reflexer så kommer smådetaljer maskeras av "gammalt ljud" som skvalpar runt. Det är därför man hör så extremt mycket detaljer med ett par riktigt bra hörlurar.

I ett rum med kort efterklang och en avsaknad av tidiga reflexer ökar artikulationsgraden tiofalt eller hundrafalt. Man kan lyssna djupare in i musiken och hör fler detaljer. Effekten är mycket, mycket större än skillnaden mellan t.ex "spitzenklasse" SB 17NBAC och "klart bättre än genomsnittet" Seas P17-RCY i mellanregistret, för att bara ta ett exempel.

Morgan skrev:Jag är lite förvånad över att ingen ställt den mer intressanta frågan: Vilka lyssningsrum ger mest microdetaljer.

Om man spelar musik i ett rum med lång efterklang och mycket tidiga reflexer så kommer smådetaljer maskeras av "gammalt ljud" som skvalpar runt. Det är därför man hör så extremt mycket detaljer med ett par riktigt bra hörlurar.

I ett rum med kort efterklang och en avsaknad av tidiga reflexer ökar artikulationsgraden tiofalt eller hundrafalt. Man kan lyssna djupare in i musiken och hör fler detaljer. Effekten är mycket, mycket större än skillnaden mellan t.ex "spitzenklasse" SB 17NBAC och "klart bättre än genomsnittet" Seas P17-RCY i mellanregistret, för att bara ta ett exempel.

Morgan skrev:Om man spelar musik i ett rum med lång efterklang och mycket tidiga reflexer så kommer smådetaljer maskeras av "gammalt ljud" som skvalpar runt.

petersteindl skrev:Bill50x skrev:petersteindl skrev:Jag ser inte kompression som ett sätt att höra mikrodetaljer. Jag menar, detaljerna blir ju inte längre detaljer.

Nä. Men det känns som att man hör saker man inte hört tidigare och därför tror man att det är "mikrodetaljer".

/ B

Fast det är inte samma sak. Antingen hör man mikrodetaljer eller också inte, fast man tror att det är mikrodetaljer.

LeifB skrev:Att få mycket detaljer kräver:

1. Låg distorsion

2. Rak frekvenskurva

3. Inga reflexer som stör.

4. Helst inga resonanser som påverka.

5. ?

Bill50x skrev:LeifB skrev:Att få mycket detaljer kräver:

1. Låg distorsion

2. Rak frekvenskurva

3. Inga reflexer som stör.

4. Helst inga resonanser som påverka.

5. ?

5. Att man tror de finns.

Det är klart de finns, men vad är definitionen? Att höra ett finger glida över en sträng på en gitarr är ingen mikrodetalj. Det är bara en närmickad gitarr, som man aldrig hör i verkliga livet. En pianist som stönar vid varje ansats, är det en mikrodetalj?

För mig är mikrodetaljer något som kan skilja tonen från en gitarrstaräng från en annan sträng. Alltså det lilla som skiijer sig hur man uppfattar ett instrument från ett annat.

/ B

Bill50x skrev:LeifB skrev:Att få mycket detaljer kräver:

1. Låg distorsion

2. Rak frekvenskurva

3. Inga reflexer som stör.

4. Helst inga resonanser som påverka.

5. ?

5. Att man tror de finns.

Det är klart de finns, men vad är definitionen? Att höra ett finger glida över en sträng på en gitarr är ingen mikrodetalj. Det är bara en närmickad gitarr, som man aldrig hör i verkliga livet. En pianist som stönar vid varje ansats, är det en mikrodetalj?

För mig är mikrodetaljer något som kan skilja tonen från en gitarrstaräng från en annan sträng. Alltså det lilla som skiijer sig hur man uppfattar ett instrument från ett annat.

/ B

petersteindl skrev:Vill man titta på mikrodetaljer på bild så zoomar man in.

Vill man höra mikrodetaljer i ljud, så zoomar man in.

petersteindl skrev:Säg att man är på konsert och man sitter långt bak i konserthuset.

Nu vill man höra mer mikrodetaljer från musikinstrument och sångare. Hur gör man då?

JM skrev:Det fysiologiska hörandet av ljuddetaljer, då speciellt i relation till de fysikaliska stimuli typ direktljud och reflexer, är mer komplext än vad avancerade fysikaliska analyser gör gällande inom akustiken.

I hjärnan finns på olika nivåer olika aktiva fysiologiska processer vilka bearbetar yttre fysikaliska ljudstimuli. Fysikaliska stimuli är extremt viktiga att registrera exakt för förstå hur hörandet fysiologiskt reagerar och hur vi slutligen upplever ljudet i den psykologiska dimensionen.

Fysiologiskt i hörselcentra i temporalloben separerar människor och djur registrerade ljud frekvenskurvemässigt med avseende på tiden, inte kontinuerligt, utan i tidsrelaterade ljudpaket med varierande upplösning beroende på ljudets karaktär. Detta sker här automatiskt kontinuerligt en koll på avvikelser/likheter mellan olika närliggande ljudpaket frekvensmässigt. Tidssepareringen ger möjlighet till jämförelse med automatiska omedvetna korrigeringar av ofta förekommande felaktiga fysiologiskt registrerade direktljud. Oklart hur och enligt vilken princip korrigeringarna sker. Medelvärdesprincipen? Finns kopplingar till tidigare ljuderfarenheter?

Ljudkorrektions processandet frekvensmässigt i temporalloberna är skild från den mer kognitiva ljudkorrigeringen i frontalloberna. I frontalloberna gissar vi mer vad större oklara ljudpaket kan vara relation till tidigare erfarenheter medans i temporalloberna kollas mer likheter/olikheter i registrerade tonkurvor? Det är klart att frekvenser över 1000 Hz är viktigare i denna automatiska temporallobsprocess än frekvenser under.

Återigen är de således helt fundamentalt att förstå den vetenskapliga separationen av att vi hör i den fysiologiska världen utifrån exakta fysikaliska ljudstimuli medans ljudupplevelsen sker i den psykologiska världen.

Tyvärr blandas allt för ofta de väsensskilda dimensionerna relaterande till hörandet på ett olyckligt sätt även i publicerade "vetenskapliga" artiklar.

JM

petersteindl skrev:petersteindl skrev:Vill man titta på mikrodetaljer på bild så zoomar man in.

Vill man höra mikrodetaljer i ljud, så zoomar man in.petersteindl skrev:Säg att man är på konsert och man sitter långt bak i konserthuset.

Nu vill man höra mer mikrodetaljer från musikinstrument och sångare. Hur gör man då?

Säg att man tittar på ett träd 30 meter från trädet. Man ser att det är ett äppelträd.

Man går fram 25 meter och befinner sig istället 5 meter från trädet. Då ser man en massa detaljer som man inte såg tidigare.

Man har i princip zoomat in något genom att närma sig.

Ett annat alternativ är att man tar fram en liten kikare då man tittar på trädet. Då zoomar man in genom förstoring och ser detaljer.

Med ljud gäller båda dessa principer. Avståndet till ljudkälla ges genom detektion av storheten ljudtryck med enheten SPL då hörseln används som mätinstrument. Det gäller frifält.

I rum är det en kvot mellan direktljudets SPL och det reflekterade ljudets SPL som hörseln detekterar och bedömer avstånd till ljudkälla på.

Vill man höra saker tydligare så kan man även fixa flärpar så att öronen blir större eller sätta händerna bakom örat. Det funkar inte genom att sätta händerna framför örat. Det är direktljudet som man zoomar in på.

Är man på konsert och sitter långt bak i konserthuset och vill höra mer mikrodetaljer från musikinstrument och sångare så går man längre fram i konserthuset och sätter sig nära scenen.

Då ökar andelen direktljud i förhållande till reflekterat ljud. Ljudet upplevs också som starkare. Toppvärdet ökar. Medelvärdet likaså, men det reflekterade ljudet minskar i nivå.

Nu har vi alltså åstadkommit en situation där toppvärdet på direktljudet ökar och medelvärdet likaså men andelen reflekterat ljud har minskat. Detaljer hörs mycket tydligare.

En sak som minskar detaljupplösning är om andelen reflekterat ljud tappar nivå i diskanten i jämförelse med direktljudet. Det kan också låta mera avlägset till ljudkällorna d v s till de upplevda ljudobjekten.

Komprimeras ljudet så kommer akustiken högre i nivå och detaljupplösningen blir sämre.

Det är i princip tvärtom till det som skrivs d v s att vid kompression skulle detaljer höras bättre. Vid live blir det tvärtom. Så uppfattar jag saken.

Man kan även föra resonemang gällande akustik i bostadsrum. Där inträffar helt andra fenomen som man måste ta hänsyn till eftersom första reflexer kommer tidsmässigt relativt tidigt så att det blir destruktiv interferens i det hörbara känsliga området. Här kommer även högtalarnas spridning i diskanten in i jämförelse med spridningen i frekvensregistret under diskanten.

Sedan finns det ytterligare parametrar som bidrar till mer levandekänsla i förhållande till uppspelning av stereosignal med 2 högtalare i döddämpat/ekofritt rum.

Det är alltså inte samma förutsättning med multikanal och exempelvis filmljud där man återger ljud från flera olika riktningar.

Det får bli en balansgång mellan direktljud och vissa reflexer vid uppspelning i bostadsrum.

JM skrev:Det fysiologiska hörandet av ljuddetaljer, då speciellt i relation till de fysikaliska stimuli typ direktljud och reflexer, är mer komplext än vad avancerade fysikaliska analyser gör gällande inom akustiken.

I hjärnan finns på olika nivåer olika aktiva fysiologiska processer vilka bearbetar yttre fysikaliska ljudstimuli. Fysikaliska stimuli är extremt viktiga att registrera exakt för förstå hur hörandet fysiologiskt reagerar och hur vi slutligen upplever ljudet i den psykologiska dimensionen.

Fysiologiskt i hörselcentra i temporalloben separerar människor och djur registrerade ljud frekvenskurvemässigt med avseende på tiden, inte kontinuerligt, utan i tidsrelaterade ljudpaket med varierande upplösning beroende på ljudets karaktär. Detta sker här automatiskt kontinuerligt en koll på avvikelser/likheter mellan olika närliggande ljudpaket frekvensmässigt. Tidssepareringen ger möjlighet till jämförelse med automatiska omedvetna korrigeringar av ofta förekommande felaktiga fysiologiskt registrerade direktljud. Oklart hur och enligt vilken princip korrigeringarna sker. Medelvärdesprincipen? Finns kopplingar till tidigare ljuderfarenheter?

Ljudkorrektions processandet frekvensmässigt i temporalloberna är skild från den mer kognitiva ljudkorrigeringen i frontalloberna. I frontalloberna gissar vi mer vad större oklara ljudpaket kan vara relation till tidigare erfarenheter medans i temporalloberna kollas mer likheter/olikheter i registrerade tonkurvor? Det är klart att frekvenser över 1000 Hz är viktigare i denna automatiska temporallobsprocess än frekvenser under.

Återigen är de således helt fundamentalt att förstå den vetenskapliga separationen av att vi hör i den fysiologiska världen utifrån exakta fysikaliska ljudstimuli medans ljudupplevelsen sker i den psykologiska världen.

Tyvärr blandas allt för ofta de väsensskilda dimensionerna relaterande till hörandet på ett olyckligt sätt även i publicerade "vetenskapliga" artiklar.

JM

I-or skrev:Mja, en lagom dos horisontella reflektioner är ett måste för att dölja stereosystemets inneboende brister. Högtalare med hög riktverkan och/eller lyssning i ekofritt rum ger stora likheter med hörlurslyssning, där den spatiella presentationen är klart bristfällig.

LeifB skrev:I-or skrev:Mja, en lagom dos horisontella reflektioner är ett måste för att dölja stereosystemets inneboende brister. Högtalare med hög riktverkan och/eller lyssning i ekofritt rum ger stora likheter med hörlurslyssning, där den spatiella presentationen är klart bristfällig.

Går det att jämnföra högtalare och hörlurar?

Jag kan höra i min anläggning att röster är bakom högtalarna. Det går inte att höra i hörlurar. Inte i mina iallafall.

Nej högtalare ger en större upplevelse.

Hörlurarna kan vara bättre på microdetaljer.

Chris71 skrev:LeifB skrev:I-or skrev:Mja, en lagom dos horisontella reflektioner är ett måste för att dölja stereosystemets inneboende brister. Högtalare med hög riktverkan och/eller lyssning i ekofritt rum ger stora likheter med hörlurslyssning, där den spatiella presentationen är klart bristfällig.

Går det att jämnföra högtalare och hörlurar?

Jag kan höra i min anläggning att röster är bakom högtalarna. Det går inte att höra i hörlurar. Inte i mina iallafall.

Nej högtalare ger en större upplevelse.

Hörlurarna kan vara bättre på microdetaljer.

Nu tror jag jämförelsen gällde elements möjlighet att återge detaljer, jag har åtminstone ett antal par hörlurar som gör det galant.

Men som I-or skrev så innebär det inte att det presenterar en målande bild av vad som hände vid inspelningen, vår hjärnas förmåga att avkoda ljud är inte så enkel.

petersteindl skrev:petersteindl skrev:Vill man titta på mikrodetaljer på bild så zoomar man in.

Vill man höra mikrodetaljer i ljud, så zoomar man in.petersteindl skrev:Säg att man är på konsert och man sitter långt bak i konserthuset.

Nu vill man höra mer mikrodetaljer från musikinstrument och sångare. Hur gör man då?

Säg att man tittar på ett träd 30 meter från trädet. Man ser att det är ett äppelträd.

Man går fram 25 meter och befinner sig istället 5 meter från trädet. Då ser man en massa detaljer som man inte såg tidigare.

Man har i princip zoomat in något genom att närma sig.

Ett annat alternativ är att man tar fram en liten kikare då man tittar på trädet. Då zoomar man in genom förstoring och ser detaljer.

Med ljud gäller båda dessa principer. Avståndet till ljudkälla ges genom detektion av storheten ljudtryck med enheten SPL då hörseln används som mätinstrument. Det gäller frifält.

I rum är det en kvot mellan direktljudets SPL och det reflekterade ljudets SPL som hörseln detekterar och bedömer avstånd till ljudkälla på.

Vill man höra saker tydligare så kan man även fixa flärpar så att öronen blir större eller sätta händerna bakom örat. Det funkar inte genom att sätta händerna framför örat. Det är direktljudet som man zoomar in på.

Är man på konsert och sitter långt bak i konserthuset och vill höra mer mikrodetaljer från musikinstrument och sångare så går man längre fram i konserthuset och sätter sig nära scenen.

Då ökar andelen direktljud i förhållande till reflekterat ljud. Ljudet upplevs också som starkare. Toppvärdet ökar. Medelvärdet likaså, men det reflekterade ljudet minskar i nivå.

Nu har vi alltså åstadkommit en situation där toppvärdet på direktljudet ökar och medelvärdet likaså men andelen reflekterat ljud har minskat. Detaljer hörs mycket tydligare.

En sak som minskar detaljupplösning är om andelen reflekterat ljud tappar nivå i diskanten i jämförelse med direktljudet. Det kan också låta mera avlägset till ljudkällorna d v s till de upplevda ljudobjekten.

Komprimeras ljudet så kommer akustiken högre i nivå och detaljupplösningen blir sämre.

Det är i princip tvärtom till det som skrivs d v s att vid kompression skulle detaljer höras bättre. Vid live blir det tvärtom. Så uppfattar jag saken.

Man kan även föra resonemang gällande akustik i bostadsrum. Där inträffar helt andra fenomen som man måste ta hänsyn till eftersom första reflexer kommer tidsmässigt relativt tidigt så att det blir destruktiv interferens i det hörbara känsliga området. Här kommer även högtalarnas spridning i diskanten in i jämförelse med spridningen i frekvensregistret under diskanten.

Sedan finns det ytterligare parametrar som bidrar till mer levandekänsla i förhållande till uppspelning av stereosignal med 2 högtalare i döddämpat/ekofritt rum.

Det är alltså inte samma förutsättning med multikanal och exempelvis filmljud där man återger ljud från flera olika riktningar.

Det får bli en balansgång mellan direktljud och vissa reflexer vid uppspelning i bostadsrum.

I-or skrev:Mja, en lagom dos horisontella reflektioner är ett måste för att dölja stereosystemets inneboende brister. Högtalare med hög riktverkan och/eller lyssning i ekofritt rum ger stora likheter med hörlurslyssning, där den spatiella presentationen är klart bristfällig.

petersteindl skrev:Jag vill kommentera både JMs inlägg och janschs. Inte för att kommentera något som jag anser skulle vara felaktigt. Men om information skall åskådliggöra något och öka en kunskapsnivå, så bör informationen förstås och tillfoga ny kunskap som tillför insikt och förklaring som leder till förståelse.

Varje använt ord blir då viktigt att definieras, dels för att ordet inte skall tolkas olika av olika personer dels för att ordets innebörd skall få korrekt betydelse i sammanhanget. I min förra mening har jag använt ordet ’tolka’. I det sammanhanget räknar jag med att läsarna förstår ordet ’tolka’. I det här fallet är innebörden att olika personer skulle kunna ge samma ord olika betydelse och i så fall blir vissa tolkningar felaktiga. Det kan bero på att budskapet inte är entydigt. I sådana fall kan missförstånd lätt uppstå. Det råder då tvetydighet.

I andra fall kan ordet ’tolka’ betyda ungefär samma som att översätta från ett språk till ett annat. Man kan exempelvis tolka en text från Tyska till Svenska. Ofta säger man istället att en tolk har översatt Tysk text Svenska.

Men vad menas med att ljud tolkas? Det är en aspekt man tilldelar hjärnan. Det är någon form av fysiologisk process som skall till som bygger på igenkänning och därmed utnyttjar minnesfunktion i CNS eller snarast i hjärnan gällande ljud.

T.ex. Jag hör en violin och en trumpet. Det betyder att violinens toner kan separeras från trumpetens toner. För att kunna definiera violinens toner som en violin och trumpetens toner som en trumpet, så innefattar det att man vet hur en violin respektive en trumpet låter. Det betyder att man har tidigare erfarenhet av ljudet från båda instrumenten och denna ljuderfarenhet måste finnas i någon form av minne i hjärnan. Det är en fysiologisk egenskap som kallas igenkänningsprocess. Här skulle man kunna säga att man tolkar det som en trumpet och som en violin. Men, är det verkligen rätt uttryckt? Tolkar man trumpeten som en trumpet? Kan det vara så att personen bredvid tolkar ljudet från trumpeten som en cello och ljudet från violinen som en klarinett?

Ofta används ordet ’tolka’ i samband med hjärnans processer, men jag gillar verkligen inte det ordet i samband med ljud och igenkänning av ljudkällor.

Sedan har vi riktningshörandet. Man kan exempelvis höra att violinen är 15 grader till höger och trumpeten 15 grader till vänster. Men är det så att man tolkar att violinen befinner sig 15 grader till höger? Jag säger definitivt nej till det. Det är överhuvudtaget inte fråga om någon tolkningsprocess vid riktningshörande d v s lokalisation av ljudkällor.

Hur är det med avståndsbedömning till ljudkälla. Är det en tolkningsprocess? Även om det skulle kunna vara eller är en inlärningsprocess, är det en tolkningsprocess? Här måste man sätta upp definitioner på vad en tolkningsprocess är.

Om detta kan man skriva en hel bok om. Avståndsbedömning till ljudkällor är svårt och skiljer sig markant mellan frifält kontra i rum med reflexer.

Trumpeten får sitt reflexmönster hos lyssnaren och violinen får sitt. Man hör violinens direktljud och varje reflex från violinens ljud summeras till violinen och varje reflex från trumpetens ljud summeras till trumpeten, åtminstone 1a reflex men även 2a reflex. Med efterklangen är det inte riktigt så.

På trumhinnorna d v s i den akustiska domänen summeras allt ljud, från alla instrument och alla direktljud och reflexer.

Det blir som en slags akustisk blender på respektive trumhinna. Matematiskt säger man att de akustiska ljudvågorna summeras enligt summationsprincipen i respektive punkt i rummet, exempelvis på trumhinnorna. Sätter man en mikrofon på en plats i rummet och spelar in musikinstrumenten där de spelar samtidigt och låter någon annan analysera inspelningen utan att lyssna och utan att veta vad det är, så är det nästintill eller troligtvis en helt omöjlig uppgift. Vilka tekniska analyseringsprocesser skulle i så fall användas för att veta vad som ingår i totalsumman av de olika ljuden? Jag kan inte se att det finns någon teknisk process som klarar en sådan analys. Det går helt enkelt inte. Vilken del av SPL tillhör trumpeten? Eller violinen, eller klarinetten eller valthornet osv? Och var befinner sig respektive okänd ljudkälla någonstans? Hur kan man med objektiva mätinstrument mäta på den inspelade akustiska ljudsumman? Jag kan inte se att det finns någon som helst möjlighet. Där kommer objektiva fysikaliska tekniska mätinstrument till korta.

Spelar man upp den inspelade orkestern i högtalare och istället använder hörseln som mätinstrument så kan man på några hundra millisekunder analysera ljudet och respektive instrument och respektive instruments placering, trots att allt ljud summerats på respektive trumhinna.

Här är hörseln triljarders gånger bättre än vilket objektivt tekniskt mätinstrument som helst och analysen går blixtsnabbt och med väldigt lite förbrukad energi med hörseln som mätinstrument.

Går det överhuvudtaget att bygga ett tekniskt fysikaliskt objektivt mätinstrument som klarar denna uppgift?

Jag tror det går, men då krävs det AI och simulerade neurala nätverk i datorn/mätinstrumentet och det krävs någon form av häftig dator som analyserar under viss tid. Hur bra sådant mätresultat skulle bli i förhållande till hörseln vet jag inte.

Men mitt och lilltrolls lilla experiment med inspelad musik på CD, det var Yves Montand live at Olympia. Lilltroll skrev mjukvara för AI och beräknade olika saker. Då kunde vi filtrera bort allt publikljud från rösten som applåder. Vi kunde separera olika instrument ur 2-kanalsinspelningen och lägga in dessa i separata kanaler och vi kunde göra en ny mix där vi exempelvis kunde variera avstånd till respektive instrument och sångare och sedan lägga på publikljud som vi ville. Sedan kunde vi placera musikinstrument och sångare var vi ville ha dem i ljudbilden. Vi kunde ändra på förhållandet mellan direktljudet och reflexer i inspelningen för att få distinktare rytm och större närhet till sångare med högre detaljrikedom på röster eller musikinstrument. OBS! Vi ändrade ingen frekvensgång. Ingen EQ.[ YouTube ]

Från början trodde vi att det var en totalt omöjlig uppgift. Inte ens lönt att börja. Men med AI och lilltrolls programmering så kunde häpnadsväckande resultat uppnås. Jag vågar nog påstå att med AI så kan man leka och prova sig fram och analysera och lära sig hjärnans arbetsuppgifter då det gäller att exekvera ljudinformation. Det är nästan kusligt och innebär revolution i förståelse och i att kunna handskas med ljud.

Vi fixade med en annan låt, babes in the wood med Mary Black. Jättefin låt.[ YouTube ]

Här kunde vi separera instrument och röster och vi kunde variera förhållandet mellan direktljud och reflexer på hennes röst och separat på instrumenten. På så sätt kunde vi få betydligt distinktare beat och klarare röst. Vi kunde få taktmarkeringarna distinktare och allt detta utan EQ.

Det bygger på att simulera neurala nätverk och då måste man förstå vilka som är de ingående fysiologiska processerna då hjärnan exekverar information. Vi har hyfsat koll på läget. Det var en intressant resa och vi var tagna och förvånade över resultaten och vad som går att göras, som tycktes vara en omöjlig uppgift.

Det går att skriva en mängd saker om hur hjärnan bearbetar inkommande ljudsignaler och det går att använda många ord för olika företeelser och processer.

Ordens betydelse måste dock definieras d v s det är nödvändigt villkor med krav på definition på varje enskilt ord som används för att beskriva processer och företeelser.

AI är framtidens lösningar på vissa problemställningar. Man kan se hjärnan som en sorteringsmaskin. För att sortera information så de går i rätt neurala kanaler så krävs igenkänning och därmed minne. Direktljudet går i sina kanaler och tidiga reflexer går i sina, allt beroende på skilda infallsvinklar. Dessutom går de olika frekvenserna i sina specifika celler och neuroner från de inre hårcellerna i innerörat och behåller denna relativa position i förhållande till varandra genom hjärnan och tillbaka till de yttre hårcellerna som fungerar som ett återkopplat neuralt system.

AI bygger dels på en inlärningsprocess där resultaten blir mer korrekta över en viss inlärningstid dels på flera andra komplicerade processer. Frågan är om jag vill använda ordet tolkning. Jag är inte säker på det. Ordet är förföriskt att använda i brist på annat eller för att slippa gå in på processer i detalj.

I ljudåtergivning ser jag det som att låta hela det akustiska skeendet från högtalare via rum till lyssnare, vara en process där man förbereder ljudfältet i rummet fram till öronen så att hjärnan kan sköta sorteringsarbetet så korrekt som möjligt för att höra korrekt perspektiv och ljudbild och korrekt klang på ett sådant sätt att lyssnaren befinner sig på plats vid det musikaliska inspelade skeendet.

Jag har inte korrekturläst. Hinner inte det.

Mvh

Peter

jansch skrev:Peter,

Det finns sedan länge en mängd gratisappar som separerar ut musik, sång eller annat.

jansch skrev:Peter,

Det finns sedan länge en mängd gratisappar som separerar ut musik, sång eller annat.

jansch skrev:Peter,

Det finns sedan länge en mängd gratisappar som separerar ut musik, sång eller annat.

petersteindl skrev:jansch skrev:Peter,

Det finns sedan länge en mängd gratisappar som separerar ut musik, sång eller annat.

Det känner jag inte till.

Separerar ut musik? Vad betyder det? Separerar ut annat? Vad är det?

Vilka appar är det?

Kan de t.ex. ur en monoinspelning med symfoniorkester inspelad med endast 1 mikrofon i konserthus separera ut varje instrument och därefter lägga instrumenten i skilda kanaler och sedan separera ut inspelade rumsreflexer från direktljud på respektive instrument och sedan ändra förhållandet mellan direktljud och reflekterat ljud så att man därefter kan zooma in och ut på varje instrument för sig? Då kan man nämligen mixa ihop de separerade kanalerna efteråt till en god stereoinspelning, antingen till 2 stereo kanaler eller till multikanal.

Länka gärna till sådana program.

Det viktiga i sammanhanget är att förstå hur sådant kan gå till. Att veta vilka algoritmer som behövs och vilka parametrar man har att jobba med. För, vet man det, så vet man också vilka medel hörseln har för att höra ljudbild d v s varför man hör separerade ljudkällor placerade på respektive plats, dels irl d v s live på konserthuset, dels hur hörseln fungerar vid stereoåtergivning med 2 högtalare.

LeifB skrev:petersteindl skrev:jansch skrev:Peter,

Det finns sedan länge en mängd gratisappar som separerar ut musik, sång eller annat.

Det känner jag inte till.

Separerar ut musik? Vad betyder det? Separerar ut annat? Vad är det?

Vilka appar är det?

Kan de t.ex. ur en monoinspelning med symfoniorkester inspelad med endast 1 mikrofon i konserthus separera ut varje instrument och därefter lägga instrumenten i skilda kanaler och sedan separera ut inspelade rumsreflexer från direktljud på respektive instrument och sedan ändra förhållandet mellan direktljud och reflekterat ljud så att man därefter kan zooma in och ut på varje instrument för sig? Då kan man nämligen mixa ihop de separerade kanalerna efteråt till en god stereoinspelning, antingen till 2 stereo kanaler eller till multikanal.

Länka gärna till sådana program.

Det viktiga i sammanhanget är att förstå hur sådant kan gå till. Att veta vilka algoritmer som behövs och vilka parametrar man har att jobba med. För, vet man det, så vet man också vilka medel hörseln har för att höra ljudbild d v s varför man hör separerade ljudkällor placerade på respektive plats, dels irl d v s live på konserthuset, dels hur hörseln fungerar vid stereoåtergivning med 2 högtalare.

Låter som man göra en egen mix.

Separera ut allt och bygga upp den igen.

Som sagt vilken app kan fixa det?

LeifB skrev:petersteindl skrev:jansch skrev:Peter,

Det finns sedan länge en mängd gratisappar som separerar ut musik, sång eller annat.

Det känner jag inte till.

Separerar ut musik? Vad betyder det? Separerar ut annat? Vad är det?

Vilka appar är det?

Kan de t.ex. ur en monoinspelning med symfoniorkester inspelad med endast 1 mikrofon i konserthus separera ut varje instrument och därefter lägga instrumenten i skilda kanaler och sedan separera ut inspelade rumsreflexer från direktljud på respektive instrument och sedan ändra förhållandet mellan direktljud och reflekterat ljud så att man därefter kan zooma in och ut på varje instrument för sig? Då kan man nämligen mixa ihop de separerade kanalerna efteråt till en god stereoinspelning, antingen till 2 stereo kanaler eller till multikanal.

Länka gärna till sådana program.

Det viktiga i sammanhanget är att förstå hur sådant kan gå till. Att veta vilka algoritmer som behövs och vilka parametrar man har att jobba med. För, vet man det, så vet man också vilka medel hörseln har för att höra ljudbild d v s varför man hör separerade ljudkällor placerade på respektive plats, dels irl d v s live på konserthuset, dels hur hörseln fungerar vid stereoåtergivning med 2 högtalare.

Låter som man göra en egen mix.

Separera ut allt och bygga upp den igen.

Som sagt vilken app kan fixa det?

petersteindl skrev:LeifB skrev:petersteindl skrev:Det känner jag inte till.

Separerar ut musik? Vad betyder det? Separerar ut annat? Vad är det?

Vilka appar är det?

Kan de t.ex. ur en monoinspelning med symfoniorkester inspelad med endast 1 mikrofon i konserthus separera ut varje instrument och därefter lägga instrumenten i skilda kanaler och sedan separera ut inspelade rumsreflexer från direktljud på respektive instrument och sedan ändra förhållandet mellan direktljud och reflekterat ljud så att man därefter kan zooma in och ut på varje instrument för sig? Då kan man nämligen mixa ihop de separerade kanalerna efteråt till en god stereoinspelning, antingen till 2 stereo kanaler eller till multikanal.

Länka gärna till sådana program.

Det viktiga i sammanhanget är att förstå hur sådant kan gå till. Att veta vilka algoritmer som behövs och vilka parametrar man har att jobba med. För, vet man det, så vet man också vilka medel hörseln har för att höra ljudbild d v s varför man hör separerade ljudkällor placerade på respektive plats, dels irl d v s live på konserthuset, dels hur hörseln fungerar vid stereoåtergivning med 2 högtalare.

Låter som man göra en egen mix.

Separera ut allt och bygga upp den igen.

Som sagt vilken app kan fixa det?

Det finns en app som separerar allt och bygger upp det.

Den appen finns i en dator som kallas för hjärnan.

Vill man bygga en motsvarande kopia av sådan hjärna/dator med app så finns det 2 sätt.

1. Du följer en gammal och beprövad anvisning som lyder: Varen fruktsamma och föröken eder.

2. Du bygger en kopia på hörseln i form av axlar + huvud + öron + trumhinnor + hjärna med exempelvis en Dell + Windows 10 som operativsystem + en mjukvara i form av app.

Den kopian skall uppfylla kraven att vara: In the image and in the likeness of a brain.

Nu gäller det bara att ta reda på hur den där appen ska fungera och hur den skall skrivas/programmeras för att åstadkomma korrekt slutresultat från given input. D v s, man går från en mängd akustiska ljudvågor som når 2 trumhinnor och blir till kod i nervsystemet och behandlas på visst sätt för att därefter bli ett resultat i form av output som sker på något sätt. Det är bara att sätta sig vid datorn och programmera. Man måste ju veta hur input ser ut och beskriva den med matematiska formler. Vågekvationen kan funka och hur summation av vågor ser ut matematiskt. Då hamnar ljudet i form av kod på trumhinnorna. Sedan går ljudet till mellanöra i form av mekanisk rörelse och därefter till inneröron och därefter i form av elektrokemisk kod i nervsystemet. Sedan fixar hjärnan det lilla extra, nämligen att segregera all kod till att bli skild kod beroende på respektive ljudkälla, musikinstrument, röster osv. samt även en total segregation av respektive ljudkällas första reflexer som beskriver den akustiska miljön samt respektive ljudkällas positionering i denna akustiska miljö. Direktljud och tidiga reflexer sätter respektive ljudkällas positionering i förhållande till varandra i 3 dimensioner och även på korrekt plats i den akustiska miljön som också kallas perspektiv.

Piece of cake. Hörseln fixar det på några hundra millisekunder.

I-or skrev:Man söker lämpligen på separate stems (eller möjligen demix audio). Separationen blir naturligtvis inte helt perfekt, speciellt inte om det ska handla om HiFi, men det finns massor av roliga och mycket imponerande mjukvaror att leka med (de bättre exemplen är som vanligt inte gratis).

petersteindl skrev:LeifB skrev:petersteindl skrev:Det känner jag inte till.

Separerar ut musik? Vad betyder det? Separerar ut annat? Vad är det?

Vilka appar är det?

Kan de t.ex. ur en monoinspelning med symfoniorkester inspelad med endast 1 mikrofon i konserthus separera ut varje instrument och därefter lägga instrumenten i skilda kanaler och sedan separera ut inspelade rumsreflexer från direktljud på respektive instrument och sedan ändra förhållandet mellan direktljud och reflekterat ljud så att man därefter kan zooma in och ut på varje instrument för sig? Då kan man nämligen mixa ihop de separerade kanalerna efteråt till en god stereoinspelning, antingen till 2 stereo kanaler eller till multikanal.

Länka gärna till sådana program.

Det viktiga i sammanhanget är att förstå hur sådant kan gå till. Att veta vilka algoritmer som behövs och vilka parametrar man har att jobba med. För, vet man det, så vet man också vilka medel hörseln har för att höra ljudbild d v s varför man hör separerade ljudkällor placerade på respektive plats, dels irl d v s live på konserthuset, dels hur hörseln fungerar vid stereoåtergivning med 2 högtalare.

Låter som man göra en egen mix.

Separera ut allt och bygga upp den igen.

Som sagt vilken app kan fixa det?

Det finns en app som separerar allt och bygger upp det.

Den appen finns i en dator som kallas för hjärnan.

Vill man bygga en motsvarande kopia av sådan hjärna/dator med app så finns det 2 sätt.

1. Du följer en gammal och beprövad anvisning som lyder: Varen fruktsamma och föröken eder.

2. Du bygger en kopia på hörseln i form av axlar + huvud + öron + trumhinnor + hjärna med exempelvis en Dell + Windows 10 som operativsystem + en mjukvara i form av app.

Den kopian skall uppfylla kraven att vara: In the image and in the likeness of a brain.

Nu gäller det bara att ta reda på hur den där appen ska fungera och hur den skall skrivas/programmeras för att åstadkomma korrekt slutresultat från given input. D v s, man går från en mängd akustiska ljudvågor som når 2 trumhinnor och blir till kod i nervsystemet och behandlas på visst sätt för att därefter bli ett resultat i form av output som sker på något sätt. Det är bara att sätta sig vid datorn och programmera. Man måste ju veta hur input ser ut och beskriva den med matematiska formler. Vågekvationen kan funka och hur summation av vågor ser ut matematiskt. Då hamnar ljudet i form av kod på trumhinnorna. Sedan går ljudet till mellanöra i form av mekanisk rörelse och därefter till inneröron och därefter i form av elektrokemisk kod i nervsystemet. Sedan fixar hjärnan det lilla extra, nämligen att segregera all kod till att bli skild kod beroende på respektive ljudkälla, musikinstrument, röster osv. samt även en total segregation av respektive ljudkällas första reflexer som beskriver den akustiska miljön samt respektive ljudkällas positionering i denna akustiska miljö. Direktljud och tidiga reflexer sätter respektive ljudkällas positionering i förhållande till varandra i 3 dimensioner och även på korrekt plats i den akustiska miljön som också kallas perspektiv.

Piece of cake. Hörseln fixar det på några hundra millisekunder.

jansch skrev:petersteindl skrev:LeifB skrev:

Låter som man göra en egen mix.

Separera ut allt och bygga upp den igen.

Som sagt vilken app kan fixa det?

Det finns en app som separerar allt och bygger upp det.

Den appen finns i en dator som kallas för hjärnan.

Vill man bygga en motsvarande kopia av sådan hjärna/dator med app så finns det 2 sätt.

1. Du följer en gammal och beprövad anvisning som lyder: Varen fruktsamma och föröken eder.

2. Du bygger en kopia på hörseln i form av axlar + huvud + öron + trumhinnor + hjärna med exempelvis en Dell + Windows 10 som operativsystem + en mjukvara i form av app.

Den kopian skall uppfylla kraven att vara: In the image and in the likeness of a brain.

Nu gäller det bara att ta reda på hur den där appen ska fungera och hur den skall skrivas/programmeras för att åstadkomma korrekt slutresultat från given input. D v s, man går från en mängd akustiska ljudvågor som når 2 trumhinnor och blir till kod i nervsystemet och behandlas på visst sätt för att därefter bli ett resultat i form av output som sker på något sätt. Det är bara att sätta sig vid datorn och programmera. Man måste ju veta hur input ser ut och beskriva den med matematiska formler. Vågekvationen kan funka och hur summation av vågor ser ut matematiskt. Då hamnar ljudet i form av kod på trumhinnorna. Sedan går ljudet till mellanöra i form av mekanisk rörelse och därefter till inneröron och därefter i form av elektrokemisk kod i nervsystemet. Sedan fixar hjärnan det lilla extra, nämligen att segregera all kod till att bli skild kod beroende på respektive ljudkälla, musikinstrument, röster osv. samt även en total segregation av respektive ljudkällas första reflexer som beskriver den akustiska miljön samt respektive ljudkällas positionering i denna akustiska miljö. Direktljud och tidiga reflexer sätter respektive ljudkällas positionering i förhållande till varandra i 3 dimensioner och även på korrekt plats i den akustiska miljön som också kallas perspektiv.

Piece of cake. Hörseln fixar det på några hundra millisekunder.

Näääää..... nu blev det väl fel.

Inspelat stereomaterial där man försöker separera sång, trummor etc skall ju inte förvanskas av torso etc utan förhoppningsvis vara ett perfekt urklipp av den inspelade stämman/musikinstrumentet. Annars blir det ju "kaka på kaka" oavsett om man gör mätningar eller neuroakustisk forskning.

Den akustiska lyssningsmiljön ingår ju förhoppningsvis inte heller i applikationen om man är ute efter att bedömma direktljud, fantomprojektion, etc.

Kraniet skrev:Mycket intressant.

Kan ju tillägga det häftiga faktum att det finns personer som lärt sig ekolokalisering. De cyklar tex mountainbike i skogen helt blinda

Hörseln är otroligt häftig minst sagt.

JM skrev:Trots hjärnans plasticitet lyssnar jag nu på lådhögtalare (Yamaha NS-1000) och saknar förväntade spatiala komponenter från optimalt försenade reflexer. Det finns uppenbarligen gränser för plasticiteten hos hjärnan.

https://pearl-hifi.com/06_Lit_Archive/1 ... nances.pdf

viewtopic.php?f=16&t=48126&p=2269637&hilit=Toole#p2269637

JM

petersteindl skrev:JM skrev:Trots hjärnans plasticitet lyssnar jag nu på lådhögtalare (Yamaha NS-1000) och saknar förväntade spatiala komponenter från optimalt försenade reflexer. Det finns uppenbarligen gränser för plasticiteten hos hjärnan.

https://pearl-hifi.com/06_Lit_Archive/1 ... nances.pdf

viewtopic.php?f=16&t=48126&p=2269637&hilit=Toole#p2269637

JM

Självklart är det så att hörseln är ett mätinstrument som registrerar inkommande signaler. Hörseln är rätt bra på att detektera närliggande väggars reflexer. Du skriver ’optimalt försenad reflex’. Hur definierar du en ’försenad’ reflex? Har aldrig sett uttrycket förut. Den skall dessutom vara optimalt försenad. Reflexer är alltid efter i tiden i förhållande till direktljudet. ’Försenad’ förknippar jag med då man gick på engelskalektionerna på gymnasiet.antingen är man i tid eller också är man försenad. Men optimalt försenad? Det uttrycket skall jag använda nästa gång jag är försenad. Är det samma sak som att komma i Grevens tid?

JM skrev:petersteindl skrev:JM skrev:Trots hjärnans plasticitet lyssnar jag nu på lådhögtalare (Yamaha NS-1000) och saknar förväntade spatiala komponenter från optimalt försenade reflexer. Det finns uppenbarligen gränser för plasticiteten hos hjärnan.

https://pearl-hifi.com/06_Lit_Archive/1 ... nances.pdf

viewtopic.php?f=16&t=48126&p=2269637&hilit=Toole#p2269637

JM

Självklart är det så att hörseln är ett mätinstrument som registrerar inkommande signaler. Hörseln är rätt bra på att detektera närliggande väggars reflexer. Du skriver ’optimalt försenad reflex’. Hur definierar du en ’försenad’ reflex? Har aldrig sett uttrycket förut. Den skall dessutom vara optimalt försenad. Reflexer är alltid efter i tiden i förhållande till direktljudet. ’Försenad’ förknippar jag med då man gick på engelskalektionerna på gymnasiet.antingen är man i tid eller också är man försenad. Men optimalt försenad? Det uttrycket skall jag använda nästa gång jag är försenad. Är det samma sak som att komma i Grevens tid?

I ett ekofrittrum finns inga reflexer. Direktljudet i ekofriarummet upplevs ändå som suboptimalt innan adaptation.

I vanliga lyssningsrum är de laterala reflexerna från lådhögtalare suboptimala och måste dämpas för att inte göra direktljudet suboptimalt. Dämpningen tar bort ffa de högre frekvenserna.

Samtidigt råder det konsensus inom perceptionsforskningen att de absolut viktigaste reflexerna är de laterala reflexernas högre frekvenser för optimal detaljupplevelse och direktljudsupplevelse enligt Toole, Olive, Barron, Lokki mfl.

JM

jansch skrev:Förstår faktiskt inte utgångsläget att direktljud kan vara suboptimallt eller optimalt. Ej heller att det skulle finnas en optimal mix av direktljud och diffusljud.

Hörseln egenskaper i detta sammanhang är till för att få kontroll/uppfattning om omgivningen.

Att vi kan gå in i ett ekofritt rum och till en början inte bara "lura" hörseln utan även andra sinnen beror ju på att miljön är okänd för hjärnan. Dock vi lär oss efter ett antal vistelser i "ekofri" miljö.

Samma primärkänsla kan vi ju uppleva i naturlig miljö, t.ex p en alptopp med pudersnö runt omkring. D v s småprassel från kläder blir väldigt distinkta, andning och kroppsljud hör vi inne i huvudet, det lätta -lite konstiga trycket i öronen av att omgivningen är alldeles tyst, osv.

Eller enkelt uttryckt - alla sinnen är samstämmiga om verkligetsbilden som byggs upp i hjärnan. När vi flytttar foten på alptoppen knarrar snön distinkt och så ska det vara. När vi gör samma sak i ett exofritt rum (flyttar foten) gungar nätet vi står på lätt och balansorganet och skicka info till hjärnan som stämmer med verkligheten.... när vi väl lärt oss hur ekofria rummets miljö funkar.

Så vad är suboptimalt eller optimalt? jo, när alla sinnen upplever situationen på ett sätt och är i harmoni har vi ett optimalt förhållande mellan direktljud/diffusljud. En sann bild av omgivningen skapad av bl.a hörselsinnet.

Att vi fejkar ett stereoperspektiv i ett lyssningsrum där OLIKA INSPELNINGARS efterklang ställer olika krav på rumsakustik och spridningsmönster från ljudkällorna kan bara bli en kompromiss och väldigt beroende av musiksmak och preferenser. Vilket är viktigast, perfekt och överdriven stereobild som inte finns i verkligheten eller luftighet och 3D känsla som är lika överdriven?

petersteindl skrev:jansch skrev:Förstår faktiskt inte utgångsläget att direktljud kan vara suboptimallt eller optimalt. Ej heller att det skulle finnas en optimal mix av direktljud och diffusljud.